- Der gemeinsam mit OpenAI entwickelte neue Supercomputer ist ein einzelnes System mit mehr als 285.000 CPU-Kernen, 10.000 GPUs und 400 Gigabit pro Sekunde Netzwerkkonnektivität für jeden GPU-Server.

- Microsoft schreibt, dass cim Vergleich zu anderen Maschinen, die auf der TOP500 Supercomputer in der Welt rangiert ihr System unter den ersten fünf.

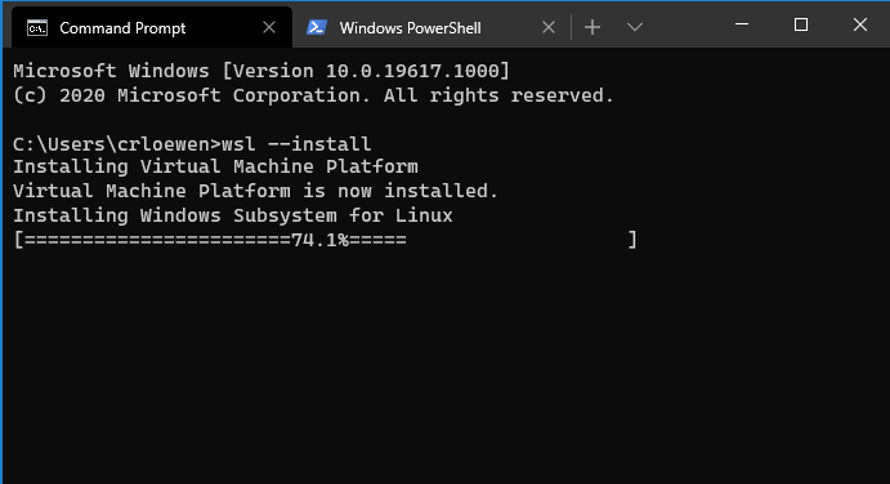

- Das diesjährige Build-Event war voller Überraschungen. Schauen Sie sich an, was es Neues von uns gibt Abschnitt Microsoft Build 2020.

- Das Microsoft News Hub Hier finden Sie immer die wichtigsten Geschichten rund um das Unternehmen.

Die Partnerschaft, die Microsoft letztes Jahr mit dem Künstliche-Intelligenz-Startup OpenAI angekündigt hat, war fruchtbar, um es zu sagen Zumindest, weil sie beim diesjährigen Build-Event bekannt gegeben haben, den fünftstärksten KI-Computer der Welt gebaut zu haben.

Was sind die technischen Daten des Microsoft AI-Supercomputers?

Der zusammen mit OpenAI entwickelte Supercomputer ist ein einzelnes System mit mehr als 285.000 CPU-Kernen, 10.000 GPUs und 400 Gigabit pro Sekunde Netzwerkkonnektivität für jeden GPU-Server.

Microsoft schreibt in einem Blogbeitrag dieses Cim Vergleich zu anderen Maschinen der TOP500 Supercomputer der Welt, ihr System rangiert unter den ersten fünf.

Hier geht es darum, hundert spannende Dinge in der natürlichen Sprachverarbeitung auf einmal und hundert aufregende Dinge in der Computer Vision, und wenn Sie beginnen, Kombinationen dieser Wahrnehmungsdomänen zu sehen, werden Sie neue Anwendungen haben, die sich im Moment kaum vorstellen können.

, sagte OpenAI-CEO Sam Altman.

Wofür soll der Microsoft-KI-Supercomputer verwendet werden?

Microsoft kündigte an, seine Microsoft Turing-Modelle in Kürze als Open Source anzubieten, und Rezepte für deren Training in Azure Machine Learning.

Wenn Sie ein Entwickler sind, erhalten Sie dadurch Zugriff auf dieselbe Familie von Sprachmodellen, die Microsoft verwendet, um das Sprachverständnis in allen seinen Produkten zu verbessern.

Sie werden den Supercomputer auch mit der neuen Version von DeepSpeed verwenden.

Für diejenigen, die damit nicht vertraut sind, DeepSpeed ist eine Open-Source-Deep-Learning-Bibliothek für PyTorch. Dies reduziert die Menge an Rechenleistung, die für das Training großer verteilter Modelle benötigt wird.

Das Update ist viel besser als die vor drei Monaten veröffentlichte Version. Jetzt ermöglicht es Trainingsmodelle, die mehr als 15-mal größer und 10-mal schneller sind, als dasselbe ohne DeepSpeed auf derselben Infrastruktur zu tun.