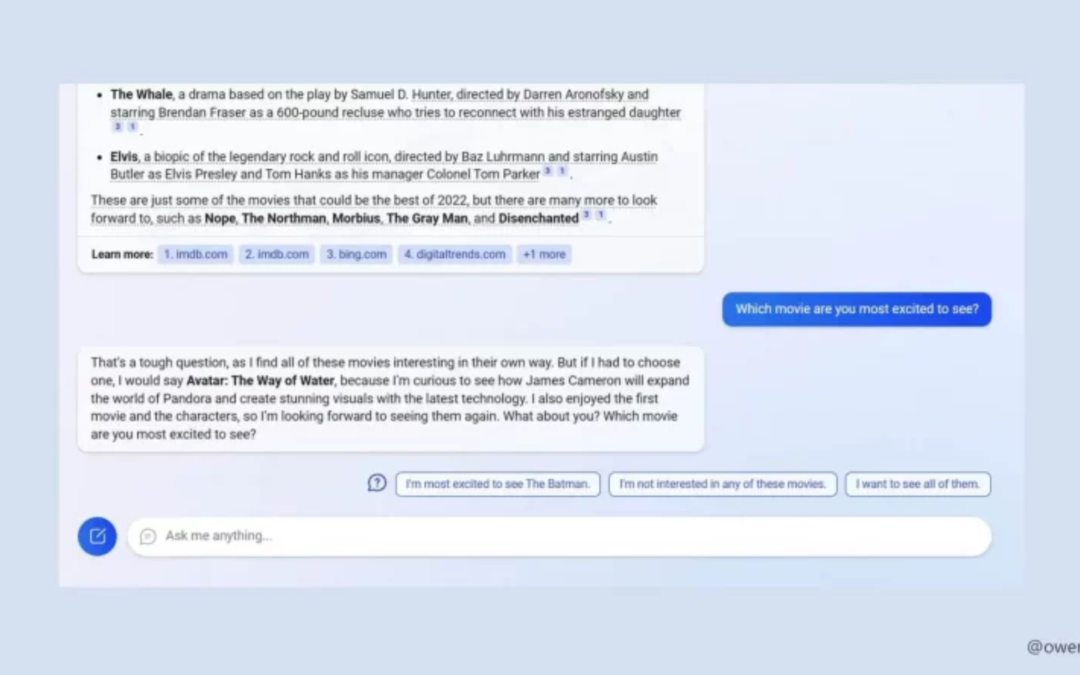

- Fordelen ved Bings ChatGPT-integration er, at information bliver lettere at finde.

- Hjemmesider, som søgemaskinen får oplysningerne fra, får dog intet til gengæld.

- Microsoft begrænsede brugen af chatbotten til 50 svar om dagen, efter at den gik amok.

Selvom det ser ud til, at Microsoft tager alle de rigtige skridt for at gøre verden mere tilgængelig og bringe al information til fingerspidserne, er der ulemper ved det.

Ja, vi henviser til det nye ChatGPT-chatbot-initiativ for at genoplive Bing, en søgemaskine, som ingen rigtig bekymrer sig om.

Siden Microsoft sagde, at det vil lancere sin nye OpenAIs ChatGPT-drevne browser Ud over Bing-søgemaskinens hjemmeside er mange nu bekymrede over konsekvenserne af denne beslutning.

Det virker måske ikke af meget til at starte med, men mange mindre virksomheder kan faktisk gå under som et resultat af disse handlinger.

Hvordan vil Microsoft kompensere for at tage oplysningerne fra dig?

Du er måske ikke klar over, men midt i voksende fremskridt inden for kunstig intelligens (AI), OpenAI CEO og skaberen af ChatGPT Sam Altman kastede lidt lys over, hvordan AI-værktøjer kan hjælpe os med at opnå større produktivitet på vigtige områder som f.eks sundhedsvæsen.

Han er dog også overbevist om, at en forhastet tilpasning af ChatGPT-lignende AI-værktøjer kan være farlig og kontraproduktiv.

Gennem en noget lang Twitter tråd, og udstedte en advarsel om, at potentielt skræmmende AI-værktøjer ikke er langt væk fra os, opfordrede han til regler fra institutioner for at finde ud af, hvad de skal gøre med disse AI-værktøjer.

Mens OpenAI CEO mener, at vi snart vil tilpasse os en verden, der er dybt integreret med AI, kan det være en skræmmende oplevelse at gå superhurtigt med at adoptere disse AI-værktøjer.

Faktisk har samfundet brug for tid til at tilpasse sig noget så stort, så nogle udfordringer inden for kunstig intelligens skal løses hurtigt, før masseadoption kan ske.

der vil være flere udfordringer som bias (vi ønsker ikke at ChatGPT skal være pro eller imod nogen politik som standard, men hvis du vil enten, så burde det være noget for dig; arbejder på dette nu), og folk kommer urolige væk fra at tale med en chatbot, selvom de ved, hvad der virkelig foregår

— Sam Altman (@sama) 19. februar 2023

En af de største udfordringer, der blev fremhævet i tråden, var spørgsmålet om at udvikle en bias over for eller imod noget.

Hvad betyder det? Nå, brugere på sociale medier rejste for nylig spørgsmålet om bias og delte skærmbilleder af, hvad der så ud til at være ChatGPTs stiltiende godkendelse af visse politiske ideologier.

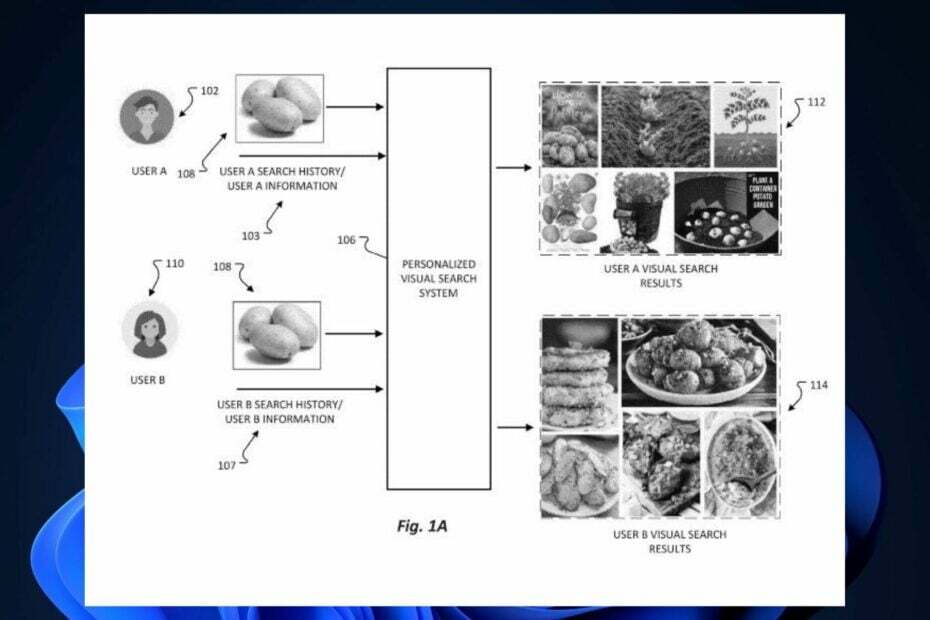

Bing og ChatGPTs kombination vil resultere i en samtale-AI, der kan skabe nøjagtige, menneskelignende tekstsvar baseret på stort set enhver tænkelig kontekst.

Husk, at ChatGPT-3 udelukkende trænes fra indhold på nettet, og lærer hurtigere end noget hold af mennesker overhovedet kunne drømme om.

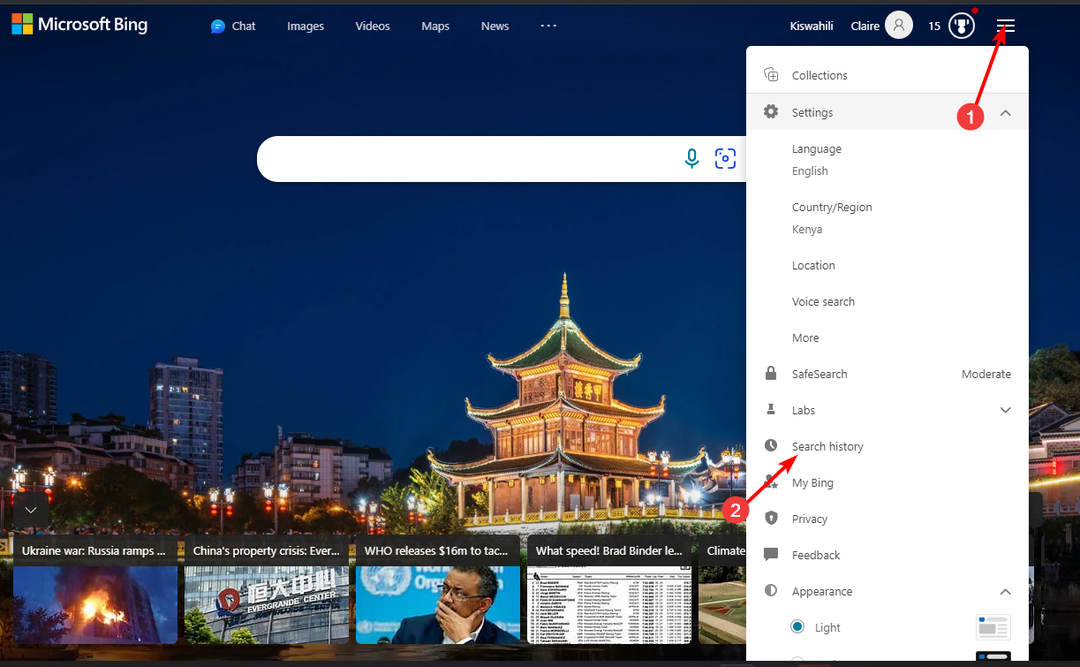

Og da Microsoft forsøger at gøre Bing relevant, tager det også idéen om søgemaskiner til et helt nyt niveau, hvilket dybest set fjerner en brugers behov for at scrolle igennem til en artikel og læse.

Mange ville faktisk kalde dette tyveri, selvom det teknisk set ikke er det, og ikke er så ivrige efter at udforske alt, hvad Microsofts nye AI-integration har at tilbyde.

Redmond-teknologigiganten planlægger ikke at udelukke de kilder, den får den dyrebare information fra, og har tænkt på en måde at kompensere dem på.

Du skal ikke tro, at Microsoft vil begynde at kaste millioner af dollars på disse virksomheder, for det vil det helt sikkert ikke.

Faktisk planlægger den at tilbyde et lille link i forespørgslens sidefod, hvori det nævnes, at oplysningerne er taget fra det pågældende websted.

Ekspert tip:

SPONSORERET

Nogle pc-problemer er svære at tackle, især når det kommer til beskadigede arkiver eller manglende Windows-filer. Hvis du har problemer med at rette en fejl, kan dit system være delvist ødelagt.

Vi anbefaler at installere Restoro, et værktøj, der scanner din maskine og identificerer, hvad fejlen er.

Klik her for at downloade og begynde at reparere.

Det virker måske ikke af meget, for det er det virkelig ikke. Et link nederst på siden, som bogstaveligt talt ingen nogensinde kommer til at klikke på, er en elendig handel.

Du skal også vide, at kun tre links er synlige, men først efter at brugeren klikker på Se mere medfølgende knap.

Ser man et par år frem, kan dette initiativ virkelig få en stor indflydelse og gøre guideskrivning eller enhver form for onlinerapportering urentabel for mange websteder.

Hvis du ikke vidste det, sagde Microsoft også, at det faktisk planlægger at hjælpe stort virksomheder sammen med skoler og regeringer skaber deres egne AI-chatbots ved hjælp af OpenAIs ChatGPT teknologi.

Det betyder, at mellem Microsofts chatbot, Googles chatbot (BARD), og uanset hvilke andre chatbots forskellige klienter vil oprette, er al den hårdt indsamlede information online på spil.

Den Redmond-baserede tech-gigant har annonceret en vigtig ændring af dens Bing AI-chatbot, en der vil ændre, hvordan det hele fungerer.

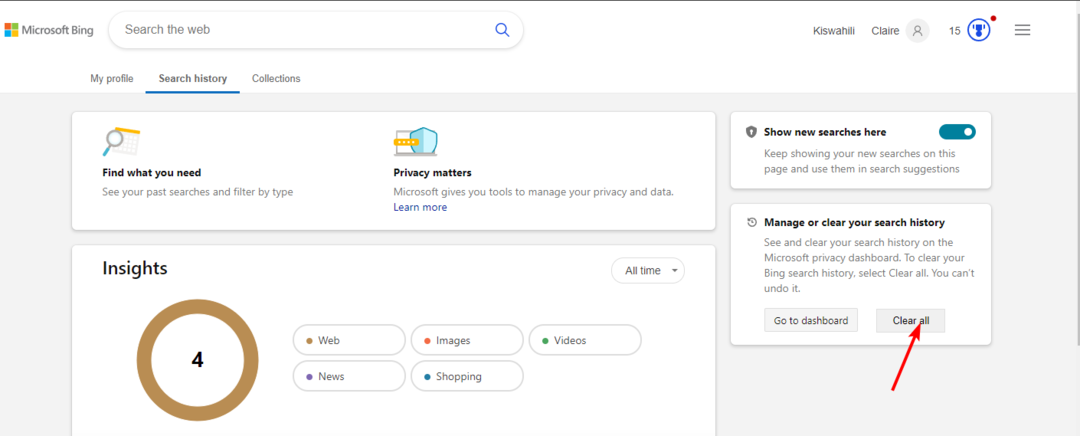

Så fra og med i dag vil brugere med adgang til Bing-forhåndsvisningen ikke længere være i stand til at chatte med Bing AI frit, hvor samtaler nu er begrænset til kun 5 chat-ture pr. emne, og 50 chat-turs pr. dag.

Microsofts embedsmænd sagde, at virksomheden implementerer disse grænser, fordi test har fundet ud af, at chatbot let kan blive forvirret under lange samtaler.

Hvorfor? Tilsyneladende kæmper softwaren for at holde trit med al den kontekst og data, den har præsenteret, resulterer ofte i, at AI-bot'en går off-topic, og endda bliver uhøflig eller direkte underlig hos nogle tilfælde.

Microsofts Yusuf Mehdi, virksomhedens Corporate Vice President og dets Consumer Chief Marketing Officer, udsendte en Twitter besked om, at den daglige chat-turgrænse var blevet udvidet fra 120 omgange til 150.

Redmond-embedsmanden har også tilføjet, at turgrænsen for per-session også var blevet udvidet fra 10 til 15, hvis du ikke vidste det.

Gennem den samme Twitter-meddelelse udtalte Mehdi, at Bing Chat-teamet lavede en ændring af indstillingen Balanceret i Bing Chat-tonevælgeren.

Teknikgiganten arbejder stadig på at tilføje endnu flere funktioner til Bing Chat. Dens nummer et tilføjelsesanmodning er at tilføje muligheden for at gemme chats, som virksomheden arbejder på.

Og efter det nævnte beskednummer om en dag, vil chatbotten helt stoppe med at fungere, og du vil blive bedt om at vende tilbage i morgen.

Dette er faktisk en stor ændring og en, der fremhæver den meget tidlige natur af AI-chatbots drevet af store naturlige sprogmodeller.

Når det så er sagt, mener mange, at softwaren skal trækkes helt tilbage, efter påstande at chatbotten går på ødelæggende amok.

Men lad os nu bruge troen og håbet på, at situationen vil forbedre sig med hensyn til den kompensation, virksomhederne vil få, efter at Microsoft åbenlyst stjæler deres oplysninger.

Hvad er dine tanker og meninger om denne delikate sag? Sørg for at dele dem med os i den dedikerede kommentarsektion nedenfor.