Project Rumi är kapabel till mänskliga svar.

- Project Rumi integrerar dina fysiska uttryck för att bilda sig en uppfattning om dina input.

- AI-språket kommer att svara dig enligt din attityd.

- Project Rumi är ett AI-genombrott, eftersom det tillåter AI-modeller att vara människoliknande.

Microsoft har investerat mycket resurser i AI-forskning under de senaste månaderna: LongMem, som erbjuder obegränsad kontextlängd, och Kosmos-2, som visualiserar rumsliga koncept och den kommer med sin egen input om dem. Då har du Orca 13B, som är öppen källkod för att du ska kunna träna dina AI-modeller.

Det finns också phi-1, som är mycket kapabel att lära sig komplexa block av Python. Och Microsoft har till och med stött forskningen om kreativ AI, som DeepRapper, vilket är, ja, du gissade rätt, en AI-rappare.

Den Redmond-baserade teknikjätten ligger före kurvan när det kommer till AI. Det tillkännagav nyligen ett partnerskap med Meta, att utveckla Llama 2, som är en LLM som har 70 miljarder parametrar, några av de mest hittills.

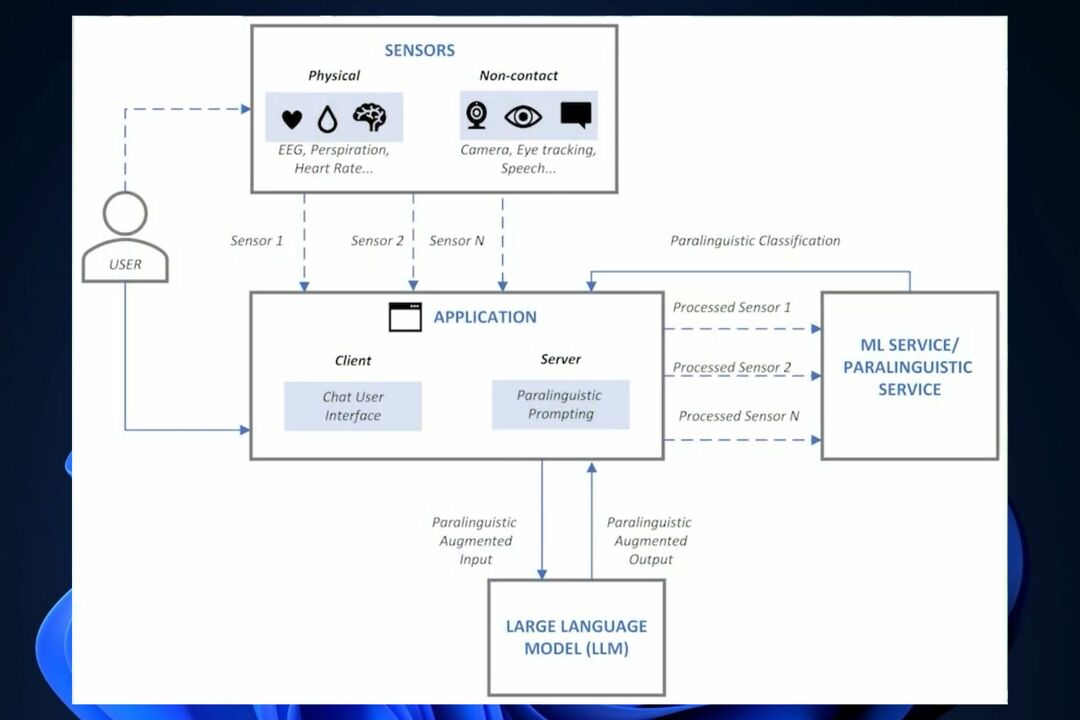

Och nu verkar det som att Microsoft också investerar i Projekt Rumi, en AI-modell som kan införliva paralingvistisk input i sina interaktioner. Detta är ett genombrott inom AI, och det kommer att föra andra modeller närmare att uppnå ett mänskligt svarssystem.

Vad är Microsoft Project Rumi?

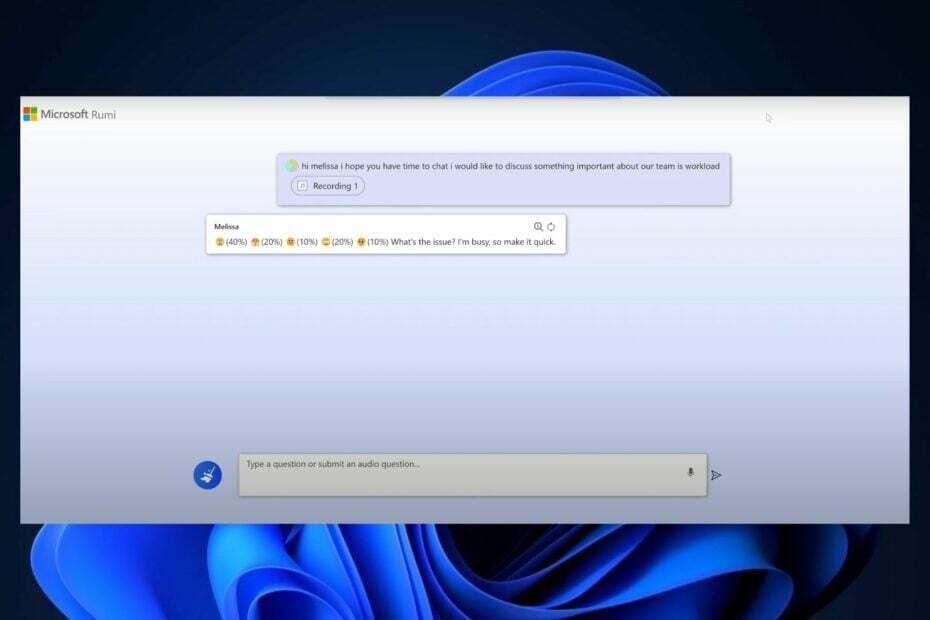

Microsoft Project Rumi är en stor språkmodell som kan integrera alla dina fysiska uttryck för att bilda sig en uppfattning om din attityd och sedan svara dig därefter. Det betyder att om du blir arg kommer modellen faktiskt att läsa ditt ansiktsuttryck och den kommer att lyssna på din röstton.

Och då kommer det att bilda ett svar som går efter din inställning.

Project Rumi gör detta genom att komma åt din mikrofon och webbkamera och det kommer faktiskt att spela in ditt ansikte för att förstå fysiska uttryck.

Project Rumi är patenterat av Microsoft i ett försök att ta itu med de nuvarande AI-modellernas begränsningar när det kommer till deras input. Till exempel kan Bing AI inte se dina ansiktsuttryck och den kan inte höra din röst när du ber den att göra något. Som en konsekvens kommer svaret att vara något konstlat och icke-mänskligt.

Microsoft Project Rumi kommer och åtgärdar dessa begränsningar genom att använda befintliga tekniska alternativ för att fånga dina mänskliga uttryck. I gengäld lär Project Rumi sig mänskliga uttryck och bygger sitt beteende utifrån dem.

Eftersom Project Rumi är en LLM kommer modellen att användas för att träna andra AI-modeller. Så du kommer snart att kunna interagera med en mänsklig AI. Låter det coolt eller inte? Vad tror du?