InstructDiffusion é capaz de compreender significados semânticos e irá utilizá-los para editar suas imagens.

- InstructDiffusion é uma IA capaz de usar instruções anteriores para obter a capacidade de compreender significados semânticos.

- O modelo também é capaz de impressionantes capacidades de generalização.

- Depois de aprender sobre uma dica visual, o modelo irá expandi-la bastante para treinar ainda mais.

O mais recente modelo de IA da Microsoft, Instruir Difusão, transformará radicalmente suas imagens, ou qualquer imagem que você possa enviar, de acordo com suas instruções. O modelo, desenvolvido pela Microsoft Research Asia, é uma interface que reúne IA e instruções humanas para gerar e completar uma variedade de tarefas visuais.

Em outras palavras, você escolhe uma imagem que deseja editar, alterar ou transformar, e o InstructDiffusion realizará sua visão computacional para alterar a imagem com base em sua entrada.

Microsoft lançou o papel para o modelo há alguns dias, e a InstructDiffusion já tem um playground de demonstração, onde você pode experimentar o modelo por si mesmo.

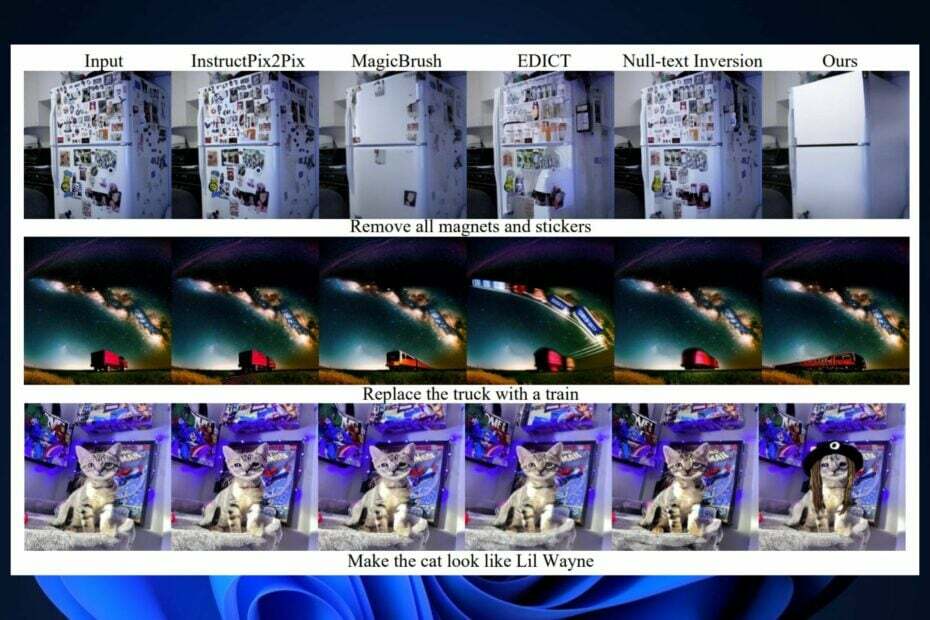

A principal inovação no IntructDiffusion é que o modelo não precisa de conhecimento prévio da imagem, mas em vez disso, usa um processo de difusão para manipular pixels. O modelo é capaz de muitos recursos úteis, como segmentação, detecção de pontos-chave e restauração. Praticamente, o InstructDiffusion usará suas instruções para alterar a imagem.

Em um exemplo, a Microsoft Research Asia conseguiu remover a marca d'água de uma foto simplesmente instruindo o modelo a fazê-lo.

O InstructDiffusion da Microsoft é capaz de distinguir o significado por trás de suas instruções

InstructDiffusion, como muitos outros Modelos de IA da Microsoft, é capaz de ter um comportamento inovador na hora de resolver tarefas. A Microsoft Research Asia afirma que o InstructDiffusion implementa tarefas de compreensão e tarefas generativas.

O modelo usará tarefas de compreensão, como segmentação e detecções de pontos-chave para localizar a área e os pixels que você deseja editar.

Por exemplo, o modelo usa segmentação para localizar com sucesso a área da seguinte instrução: pinte o homem à direita da imagem de vermelho. Para detecções de pontos-chave, uma instrução seria: use amarelo para circundar o joelho do homem na extremidade esquerda da imagem.

As tarefas generativas são compostas por tarefas de edição e restauração. Não apenas o InstructDiffusion editará sua imagem, mas o modelo também gerará novos elementos para a imagem, com base em suas instruções.

O recurso mais promissor do Microsoft InstructDiffusion é sua capacidade de generalizar com sucesso todas as instruções que recebe para formar uma compreensão coesa e profunda do significado por trás delas. Em outras palavras, o modelo se lembrará das instruções que você deu e as usará com sucesso para treinar ainda mais.

Mas o modelo também aprenderá a distinguir os significados por trás de suas instruções, levando-o a resolver tarefas invisíveis e a criar novas maneiras de gerar elementos. Essa capacidade de compreender significados semânticos coloca o InstructDifussion um passo além de outros modelos semelhantes: ele os supera.

No entanto, o InstructDiffusion também é um passo adiante para alcançar AGI: Ao compreender profundamente o significado semântico por trás de cada instrução e ser capaz de generalizar com sucesso as visões computacionais, o modelo avançará enormemente no desenvolvimento da IA.

A Microsoft Research Asia permite que você experimente em um playground de demonstração, mas você também pode use seu código para treinar seu próprio modelo de IA.

Qual a sua opinião sobre este modelo? Você vai tentar?