Najnowsze partnerstwo AI obiecuje bezpieczniejsze sposoby rozwoju AI.

- Partnerstwo zbierze radę doradców i zaplanuje strategię na kolejne miesiące.

- Skoncentruje się wyłącznie na pionierskich modelach sztucznej inteligencji, które definiuje się jako lepsze od istniejących.

- Jeśli jesteś organizacją, która rozwija takie modele AI, możesz dołączyć do partnerstwa.

Tydzień temu, Microsoft ogłosił Lamę 2, partnerstwo AI z Meta na Microsoft Inspire 2023. Llama 2 to duży model językowy typu open source, którego można używać do tworzenia i trenowania własnej sztucznej inteligencji. Mówi się również, że ten LLM jest pierwszą wskazówką do osiągnięcia AGI, co ostatecznie jest jednym z głównych celów sztucznej inteligencji.

Otóż w ciągu tygodnia od ogłoszenia sporo się wydarzyło. Krążą również pogłoski, że OpenAI, firma stojąca za ChatGPT, wypuszcza własny LLM typu open source o nazwie kodowej G3PO. Nie ma jeszcze daty premiery, ale ma to nastąpić w 2023 lub 2024 roku.

Z kolei wydaje się, że Microsoft nawiązał współpracę z Anthropic, Google i Open AI na Frontier Model Forum. Partnerstwo jest organem branżowym skoncentrowanym na zapewnieniu bezpiecznego i odpowiedzialnego rozwoju pionierskich modeli sztucznej inteligencji,

zgodnie z komunikatem prasowym.Dzisiaj Anthropic, Google, Microsoft i OpenAI ogłaszają utworzenie Frontier Model Forum, nowego organu branżowego skupionego na zapewnieniu bezpiecznego i odpowiedzialnego rozwoju modeli Frontier AI. Frontier Model Forum będzie korzystać z wiedzy technicznej i operacyjnej swoich firm członkowskich, aby przynieść korzyści całemu ekosystemowi sztucznej inteligencji, takiemu jak poprzez postęp w ocenach technicznych i testach porównawczych oraz tworzenie publicznej biblioteki rozwiązań wspierających najlepsze praktyki branżowe i standardy.

Forum modeli Frontier

Zasadniczo Frontier Model Forum chce budować sztuczną inteligencję, która nie stanowi zagrożenia dla ludzi. Jeśli pamiętacie, jeden z partnerów, Anthropic, właśnie wypuścił Klaudia 2 AI, a model jest znany ze sposobu, w jaki bezpiecznie wchodzi w interakcje z ludźmi. Tak więc będziemy mieć wiele sztucznej inteligencji podobnej do sztucznej inteligencji Claude 2, a prawdopodobnie nawet lepszej. Tak czy inaczej, to doskonała wiadomość, jeśli chodzi o tę branżę.

Co zrobi Frontier Model Forum, jeśli chodzi o sztuczną inteligencję

Partnerstwo ustaliło zestaw podstawowych celów i celów i będzie działać zgodnie z nimi. Oni są:

- Postęp w badaniach nad bezpieczeństwem sztucznej inteligencji promowanie odpowiedzialnego rozwoju modeli pionierskich, minimalizowanie ryzyka i umożliwianie niezależnych, ustandaryzowanych ocen możliwości i bezpieczeństwa.

- Identyfikacja najlepszych praktyk odpowiedzialnego rozwoju i wdrażania pionierskich modeli, pomagając społeczeństwu zrozumieć naturę, możliwości, ograniczenia i wpływ technologii.

- Współpraca z decydentami, naukowcami, społeczeństwem obywatelskim i firmami dzielenie się wiedzą na temat zagrożeń związanych z zaufaniem i bezpieczeństwem.

- Wspieranie wysiłków na rzecz tworzenia aplikacji, które mogą pomóc sprostać największym wyzwaniom społeczeństwa, takie jak łagodzenie zmiany klimatu i przystosowanie się do niej, wczesne wykrywanie raka i zapobieganie mu oraz zwalczanie cyberzagrożeń.

Partnerstwo jest również otwarte na współpracę z organizacjami

Jeśli reprezentujesz organizację opracowującą sztuczną inteligencję w modelu Frontier, możesz zgłosić chęć przyłączenia się i współpracy z Frontier Model Forum.

Porada eksperta:

SPONSOROWANE

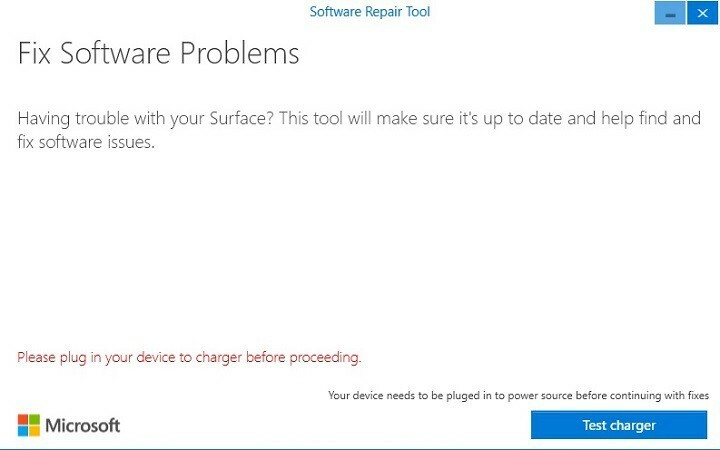

Niektóre problemy z komputerem są trudne do rozwiązania, zwłaszcza jeśli chodzi o brakujące lub uszkodzone pliki systemowe i repozytoria systemu Windows.

Pamiętaj, aby użyć dedykowanego narzędzia, takiego jak forteca, który przeskanuje i zastąpi uszkodzone pliki ich świeżymi wersjami z repozytorium.

Według Forum, pionierski model sztucznej inteligencji to model uczenia maszynowego na dużą skalę, który przekracza możliwości obecne w najbardziej zaawansowanych istniejących modelach. Powinien także być w stanie wykonywać różnorodne zadania.

Aby dołączyć do partnerstwa, jako organizacja musicie spełnić następujące kryteria:

- Opracowujecie już i wdrażacie modele pionierskie (zgodnie z definicją Forum).

- Organizacja jest w stanie wykazać silne zaangażowanie w bezpieczeństwo modeli pionierskich, w tym poprzez podejście techniczne i instytucjonalne.

- Ty, jako organizacja, jesteś gotów przyczynić się do rozwoju działań Forum, w tym poprzez udział we wspólnych inicjatywach oraz wspieranie rozwoju i funkcjonowania inicjatywy.

To właśnie zrobi Forum, jeśli chodzi o sztuczną inteligencję

Frontier Model Forum chce wspierać bezpieczny i odpowiedzialny proces rozwoju sztucznej inteligencji i skupi się na 3 kluczowych obszarach w 2023 r.:

- Identyfikacja najlepszych praktyk: Promuj dzielenie się wiedzą i najlepszymi praktykami, koncentrując się na normach bezpieczeństwa i praktykach bezpieczeństwa, aby ograniczyć szeroki zakres potencjalnych zagrożeń.

- Postęp badań nad bezpieczeństwem sztucznej inteligencji: Wspieraj ekosystem bezpieczeństwa sztucznej inteligencji, identyfikując najważniejsze otwarte pytania badawcze dotyczące bezpieczeństwa sztucznej inteligencji. Forum będzie koordynować badania, aby poczynić postępy w tych wysiłkach w takich obszarach, jak siła kontradyktoryjności, mechanistyczna interpretacja, skalowalny nadzór, niezależny dostęp do badań, pojawiające się zachowania i anomalie wykrycie. Początkowo duży nacisk zostanie położony na rozwój i udostępnianie publicznej biblioteki ocen technicznych i testów porównawczych dla pionierskich modeli sztucznej inteligencji.

- Ułatwianie wymiany informacji między firmami i rządami: Stwórz zaufane, bezpieczne mechanizmy udostępniania informacji między firmami, rządami i odpowiednimi zainteresowanymi stronami w zakresie bezpieczeństwa i ryzyka związanego ze sztuczną inteligencją. Forum będzie przestrzegać najlepszych praktyk w zakresie odpowiedzialnego ujawniania informacji z obszarów takich jak cyberbezpieczeństwo.

W ciągu 2023 roku forum Frontier Model będzie pracowało nad złożeniem zarządu, a następnie zbuduje strategię i ustali priorytety. Ale organizacja już teraz chce współpracować z jak największą liczbą instytucji, prywatnych lub publicznych. Obejmuje to również społeczeństwa obywatelskie i rządy, a także inne instytucje zainteresowane sztuczną inteligencją.

Co sądzisz o tym nowym partnerstwie? Czy jesteś zainteresowany dołączeniem? A może interesują Cię pionierskie modele sztucznej inteligencji? Daj nam znać w sekcji komentarzy poniżej.