Project Rumi er i stand til menneskelignende svar.

- Project Rumi integrerer dine fysiske uttrykk for å danne deg en mening om innspillene dine.

- AI-språket vil svare deg i henhold til din holdning.

- Project Rumi er et AI-gjennombrudd, ettersom det gjør det mulig for AI-modeller å være menneskelignende.

Microsoft har investert mye ressurser i AI-forskning de siste månedene: LongMem, som tilbyr ubegrenset kontekstlengde, og Kosmos-2, som visualiserer romlige konsepter og den kommer med egne innspill om dem. Da har du Orca 13B, som er åpen kildekode for å trene AI-modellene dine.

Det er også phi-1, som er svært i stand til å lære komplekse blokker av Python. Og Microsoft har til og med støttet forskningen på kreativ AI, som DeepRapper, som er, ja, du gjettet riktig, en AI-rapper.

Den Redmond-baserte teknologigiganten ligger foran kurven når det kommer til AI. Det kunngjorde nylig et samarbeid med Meta, å utvikle Llama 2, som er en LLM som har 70 milliarder parametere, noen av de mest så langt.

Og nå ser det ut til at Microsoft også investerer i

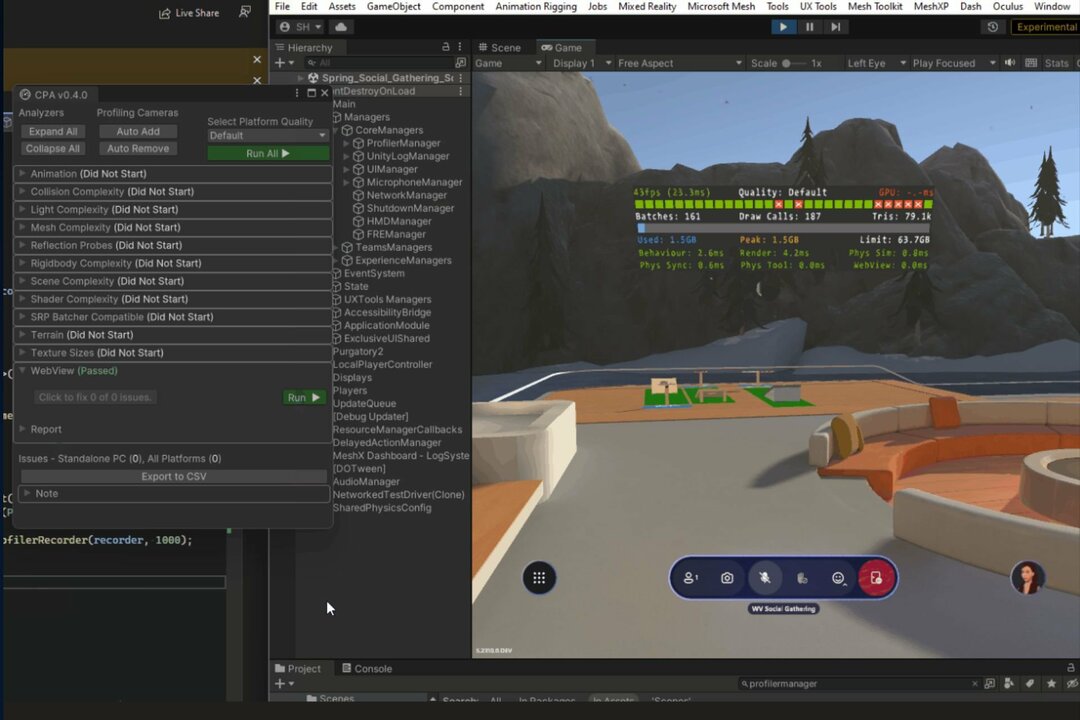

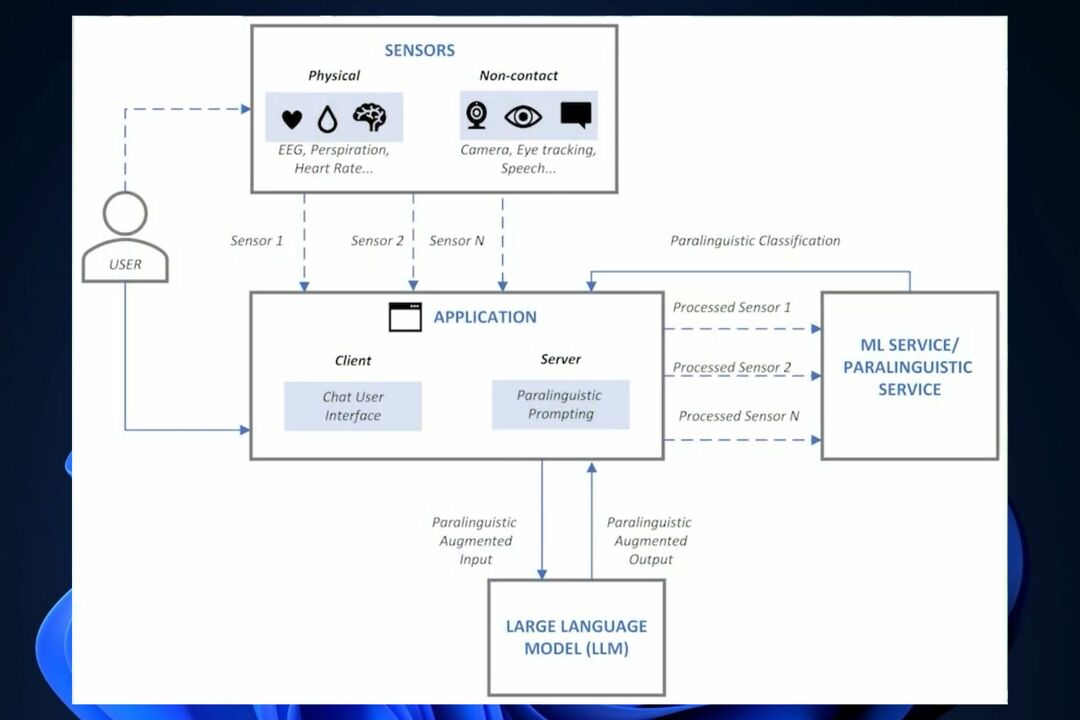

Prosjekt Rumi, en AI-modell som er i stand til å inkorporere paralingvistisk input i sine interaksjoner. Dette er et gjennombrudd innen AI, og det vil bringe andre modeller nærmere å oppnå et menneskelignende responssystem.Hva er Microsoft Project Rumi?

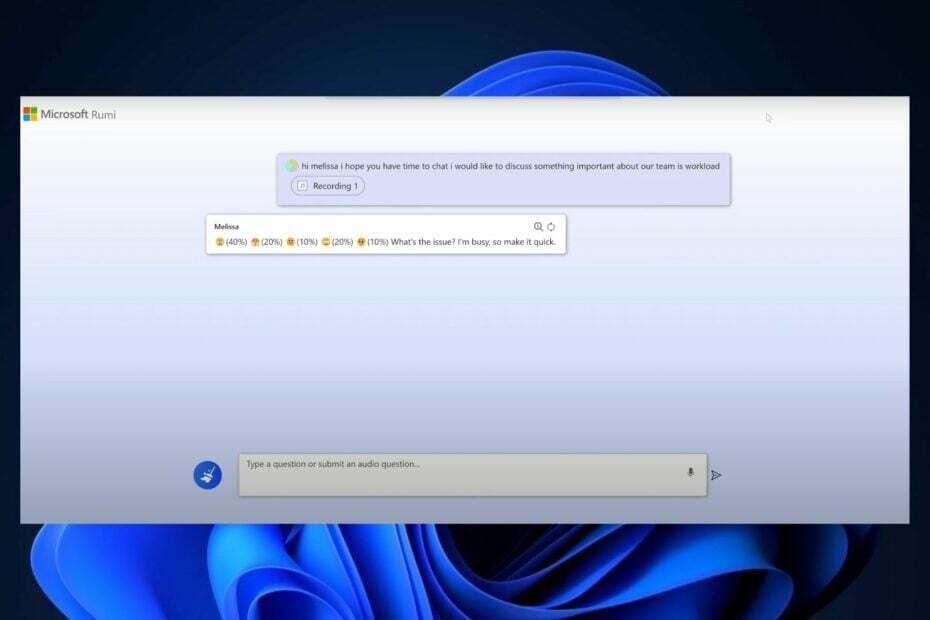

Microsoft Project Rumi er en stor språkmodell som er i stand til å integrere alle dine fysiske uttrykk for å danne seg en mening om holdningen din og deretter svare deg deretter. Dette betyr at hvis du fremstår som sint, vil modellen faktisk lese ansiktsuttrykket ditt, og den vil lytte til stemmen din.

Og så vil det danne et svar som går i henhold til din holdning.

Project Rumi gjør dette ved å få tilgang til mikrofonen og webkameraet ditt, og det vil faktisk ta opp ansiktet ditt for å forstå fysiske uttrykk.

Project Rumi er patentert av Microsoft i et forsøk på å adressere de nåværende AI-modellenes begrensninger når det kommer til deres input. For eksempel kan ikke Bing AI se ansiktsuttrykkene dine, og den kan ikke høre stemmen din når du ber den om å gjøre noe. Som en konsekvens vil svaret være noe kunstig og ikke-menneskelig.

Microsoft Project Rumi kommer og adresserer disse begrensningene ved å bruke eksisterende tekniske alternativer for å fange dine menneskelige uttrykk. Til gjengjeld lærer Project Rumi menneskelige uttrykk og bygger sin atferd basert på dem.

Siden Project Rumi er en LLM, vil modellen bli brukt til å trene andre AI-modeller. Så du vil snart kunne samhandle med en menneskelignende AI. Høres det kult ut eller ikke? Hva tror du?