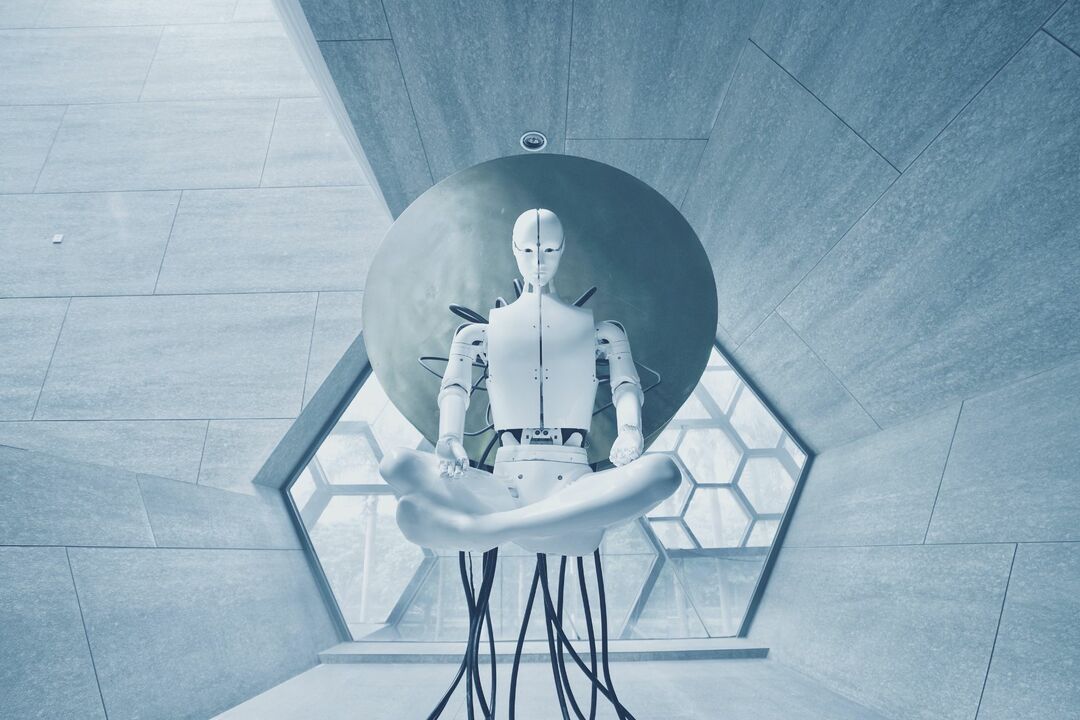

Jaunākā AI partnerība sola drošākus veidus, kā attīstīt AI.

- Partnerība sapulcēs padomnieku padomi un plānos stratēģiju nākamajos mēnešos.

- Tas koncentrēsies tikai uz AI modeļiem, kas ir definēti kā labāki par esošajiem modeļiem.

- Ja esat organizācija, kas izstrādā šādus AI modeļus, varat pievienoties partnerībai.

Pirms nedēļas, Microsoft paziņoja par Llama 2, tā AI partnerība ar Meta programmā Microsoft Inspire 2023. Llama 2 ir atvērtā pirmkoda lielas valodas modelis, ko varat izmantot, lai izveidotu un apmācītu savu AI. Tiek baumots, ka šis LLM ir arī pirmais pavediens AGI sasniegšanā, kas galu galā ir viens no AI galvenajiem mērķiem.

Nu, nedēļas laikā pēc paziņojuma daudz kas ir noticis. Ir arī baumas, ka OpenAI, uzņēmums, kas atrodas aiz ChatGPT, izlaiž savu atvērtā koda LLM ar koda nosaukumu G3PO. Tam vēl nav zināms izlaišanas datums, taču tas notiks 2023. gadā vai 2024. gadā.

Un notikumu pavērsienā šķiet, ka Microsoft ir sadarbojusies ar Anthropic, Google un Open AI Frontier modeļu forumā. Partnerība ir nozares organizācija, kuras mērķis ir nodrošināt drošu un atbildīgu progresīvu AI modeļu attīstību,

saskaņā ar paziņojumu presei.Šodien Anthropic, Google, Microsoft un OpenAI paziņo par Frontier Model Forum - jaunas nozares organizācijas izveidi, kuras mērķis ir nodrošināt drošu un atbildīgu pierobežas AI modeļu izstrādi. Frontier modeļu forums izmantos tā dalībnieku uzņēmumu tehniskās un darbības zināšanas, lai gūtu labumu visai AI ekosistēmai, piemēram, uzlabojot tehniskos novērtējumus un etalonus un izstrādājot publisku risinājumu bibliotēku, lai atbalstītu nozares labāko praksi un standartiem.

Frontier modeļu forums

Būtībā Frontier modeļu forums vēlas izveidot AI, kas nerada risku cilvēkiem. Ja atceraties, viens no partneriem Anthropic tikko atbrīvots Klods 2 AI, un modelis ir slavens ar to, kā tas droši mijiedarbojas ar cilvēkiem. Tātad mums būs daudz AI, kas līdzinās Claude 2 AI un, iespējams, vēl labāk. Katrā ziņā tās ir lieliskas ziņas, kad runa ir par šo nozari.

Ko darīs Frontier modeļu forums, kad runa ir par AI

Partnerība ir noteikusi pamatmērķu un uzdevumu kopumu, un tā darbosies saskaņā ar tiem. Viņi ir:

- AI drošības pētījumu attīstība veicināt atbildīgu pierobežas modeļu izstrādi, samazināt riskus un nodrošināt neatkarīgu, standartizētu spēju un drošības novērtējumu.

- Labākās prakses noteikšana par atbildīgu pierobežas modeļu izstrādi un ieviešanu, palīdzot sabiedrībai izprast tehnoloģijas būtību, iespējas, ierobežojumus un ietekmi.

- Sadarbība ar politikas veidotājiem, akadēmiskajiem aprindām, pilsonisko sabiedrību un uzņēmumiem dalīties zināšanās par uzticības un drošības riskiem.

- Atbalstīt centienus izstrādāt lietojumprogrammas, kas var palīdzēt risināt sabiedrības lielākās problēmas, piemēram, klimata pārmaiņu mazināšana un pielāgošanās tām, agrīna vēža atklāšana un profilakse, kā arī kiberdraudu apkarošana.

Partnerība ir atvērta arī sadarbībai ar organizācijām

Ja esat organizācija, kas izstrādā AI pierobežas modeļa modeļus, varat iesniegt pieteikumu, lai pievienotos Frontier modeļu forumam un sadarbotos ar to.

Eksperta padoms:

SPONSORĒTS

Dažas datora problēmas ir grūti atrisināt, it īpaši, ja runa ir par trūkstošiem vai bojātiem sistēmas failiem un Windows krātuvēm.

Noteikti izmantojiet īpašu rīku, piemēram, Fortect, kas skenēs un aizstās jūsu bojātos failus ar to jaunākajām versijām no tās krātuves.

Saskaņā ar forumu, robežmodelis AI ir liela mēroga mašīnmācības modelis, kas pārsniedz iespējas, kas pašlaik ir vismodernākajos esošajos modeļos. Un tai arī jāspēj veikt visdažādākos uzdevumus.

Lai pievienotos partnerībai, jums kā organizācijai ir jāatbilst šādiem kritērijiem:

- Jūs jau izstrādājat un izvietojat pierobežas modeļus (kā noteikts forumā).

- Organizācija spēj demonstrēt stingru apņemšanos nodrošināt pierobežas modeļu drošību, tostarp izmantojot tehniskas un institucionālas pieejas.

- Jūs kā organizācija esat gatavs dot savu ieguldījumu foruma centienu veicināšanā, tostarp piedaloties kopīgās iniciatīvās un atbalstot iniciatīvas attīstību un darbību.

Tas ir tas, ko forums darīs, kad runa ir par AI

Frontier Model Forum vēlas atbalstīt drošu un atbildīgu AI izstrādes procesu, un tas 2023. gadā koncentrēsies uz 3 galvenajām jomām:

- Labākās prakses noteikšana: Veiciniet zināšanu apmaiņu un paraugpraksi, koncentrējoties uz drošības standartiem un drošības praksi, lai mazinātu plašu iespējamo risku klāstu.

- AI drošības pētījumu uzlabošana: Atbalstiet AI drošības ekosistēmu, nosakot svarīgākos atklātos pētniecības jautājumus par AI drošību. Forums koordinēs pētījumus, lai veicinātu šos centienus tādās jomās kā pretrunīgums, mehāniska interpretējamība, mērogojama pārraudzība, neatkarīga pieeja pētniecībai, jauna uzvedība un anomālija atklāšana. Sākotnēji liela uzmanība tiks pievērsta tam, lai izstrādātu un koplietotu publisko AI modeļu tehnisko novērtējumu un etalonu bibliotēku.

- Informācijas apmaiņas veicināšana starp uzņēmumiem un valdībām: Izveidojiet uzticamus, drošus mehānismus informācijas apmaiņai starp uzņēmumiem, valdībām un attiecīgajām ieinteresētajām personām par AI drošību un riskiem. Forums ievēros paraugpraksi atbildīgas informācijas izpaušanā tādās jomās kā kiberdrošība.

2023. gada laikā Frontier Model forumā strādās pie padomes komplektēšanas, pēc tam izstrādās stratēģiju un noteiks prioritātes. Taču organizācija jau tagad vēlas sadarboties ar pēc iespējas vairāk institūciju, privātām vai valsts iestādēm. Tas ietver arī pilsoniskās sabiedrības un valdības, kā arī citas institūcijas, kuras interesē AI.

Ko jūs domājat par šo jauno partnerību? Vai jūs interesē pievienoties? Vai arī jūs interesē AI modeļi? Paziņojiet mums tālāk komentāru sadaļā.