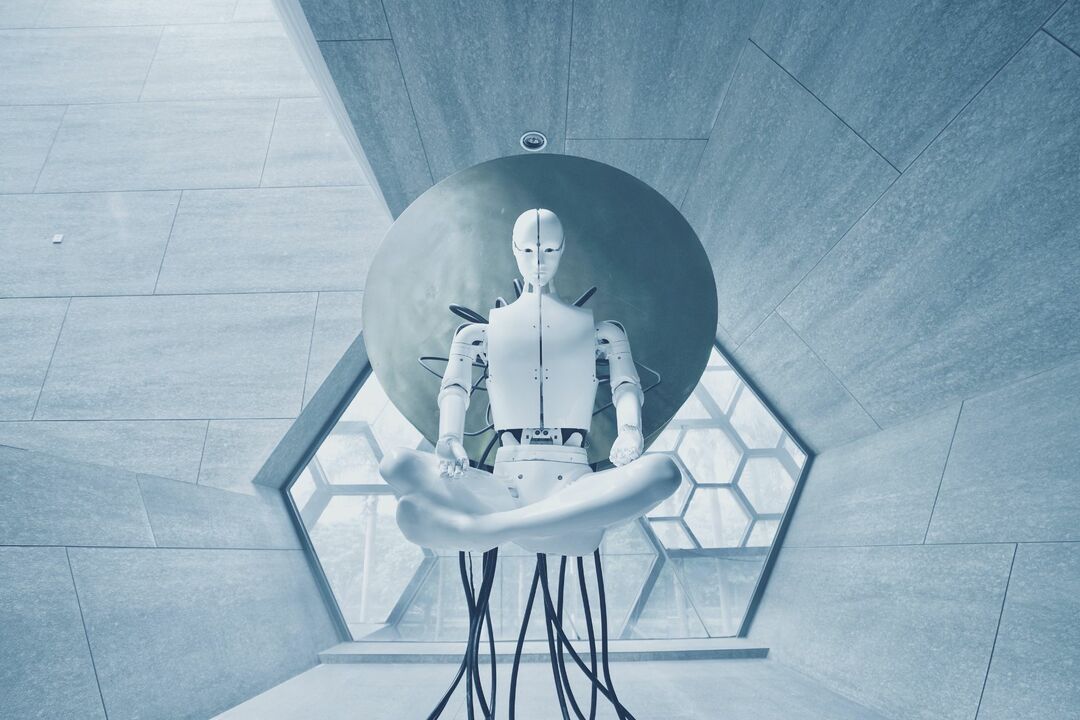

AI-ის უახლესი პარტნიორობა გვპირდება უფრო უსაფრთხო გზებს ხელოვნური ინტელექტის განვითარებისთვის.

- პარტნიორობა შეკრებს მრჩეველთა საბჭოს და დაგეგმავს სტრატეგიას მომდევნო თვეებში.

- იგი ყურადღებას გაამახვილებს ექსკლუზიურად სასაზღვრო ხელოვნური ინტელექტის მოდელებზე, რომლებიც განისაზღვრა, რომ აღემატება არსებულს.

- თუ თქვენ ხართ ორგანიზაცია, რომელიც ავითარებს AI-ის ასეთ მოდელებს, შეგიძლიათ შეუერთდეთ პარტნიორობას.

Ერთი კვირის წინ, Microsoft-მა გამოაცხადა Llama 2, მისი AI პარტნიორობა Meta-სთან, Microsoft Inspire 2023-ზე. Llama 2 არის ღია კოდის დიდი ენის მოდელი, რომელიც შეგიძლიათ გამოიყენოთ საკუთარი ხელოვნური ინტელექტის შესაქმნელად და მოსამზადებლად. ეს LLM ასევე ჭორებია, როგორც პირველი მინიშნება AGI-ს მიღწევაში, რაც, საბოლოო ჯამში, ხელოვნური ინტელექტის ერთ-ერთი მთავარი მიზანია.

ისე, გამოცხადებიდან ერთ კვირაში ბევრი რამ მოხდა. ასევე არსებობს ჭორები, რომ OpenAI, კომპანია ChatGPT-ის უკან, ავრცელებს საკუთარ ღია კოდის LLM-ს, კოდური სახელწოდებით G3PO. ჯერ არ არის გამოსვლის თარიღი, მაგრამ ეს მოხდება 2023 ან 2024 წელს.

და მოვლენების მხრივ, როგორც ჩანს, Microsoft-მა პარტნიორობა გაუწია Anthropic-ს, Google-ს და Open AI-ს Frontier Model Forum-ში. პარტნიორობა არის ინდუსტრიული ორგანო, რომელიც ორიენტირებულია სასაზღვრო ხელოვნური ინტელექტის მოდელების უსაფრთხო და პასუხისმგებელი განვითარების უზრუნველსაყოფად. პრესრელიზის მიხედვით.

დღეს Anthropic, Google, Microsoft და OpenAI აცხადებენ Frontier Model Forum-ის ფორმირებას, ახალი ინდუსტრიის ორგანოს, რომელიც ორიენტირებულია სასაზღვრო AI მოდელების უსაფრთხო და პასუხისმგებლობით განვითარებაზე. Frontier Model Forum გამოიყენებს მისი წევრი კომპანიების ტექნიკურ და ოპერაციულ გამოცდილებას, რათა სარგებელს მოუტანოს მთელი AI ეკოსისტემა, როგორიცაა ტექნიკური შეფასებებისა და ეტალონების წინსვლის გზით და გადაწყვეტილებების საჯარო ბიბლიოთეკის შემუშავებით, ინდუსტრიის საუკეთესო პრაქტიკისა და პრაქტიკის მხარდასაჭერად. სტანდარტები.

Frontier Model Forum

ძირითადად, Frontier Model Forum-ს სურს შექმნას AI-ები, რომლებიც არ წარმოადგენს საფრთხეს ადამიანებისთვის. თუ გახსოვთ, ერთ-ერთი პარტნიორი, ანთროპიკი, ახლახან გაათავისუფლეს კლოდ 2 AIდა მოდელი ცნობილია ადამიანებთან უსაფრთხო ურთიერთქმედებით. ასე რომ, ჩვენ ვაპირებთ ბევრი AI-ის მსგავსი Claude 2 AI-ს და, ალბათ, უკეთესიც. ნებისმიერ შემთხვევაში, ეს შესანიშნავი სიახლეა, როდესაც საქმე ეხება ამ ინდუსტრიას.

რას გააკეთებს Frontier Model Forum, როდესაც საქმე AI-ს ეხება

პარტნიორობამ ჩამოაყალიბა ძირითადი მიზნებისა და ამოცანების ნაკრები და ის იმუშავებს მათ შესაბამისად. Ისინი არიან:

- AI უსაფრთხოების კვლევის წინსვლა ხელი შეუწყოს სასაზღვრო მოდელების პასუხისმგებლობით განვითარებას, რისკების მინიმიზაციას და შესაძლებლობებისა და უსაფრთხოების დამოუკიდებელი, სტანდარტიზებული შეფასების შესაძლებლობას.

- საუკეთესო პრაქტიკის იდენტიფიცირება სასაზღვრო მოდელების პასუხისმგებლობით შემუშავებისა და განლაგებისთვის, რაც ეხმარება საზოგადოებას ტექნოლოგიის ბუნების, შესაძლებლობების, შეზღუდვებისა და ზემოქმედების გაგებაში.

- თანამშრომლობს პოლიტიკის შემქმნელებთან, მეცნიერებთან, სამოქალაქო საზოგადოებასთან და კომპანიებთან ნდობისა და უსაფრთხოების რისკების შესახებ ცოდნის გაზიარება.

- აპლიკაციების შემუშავების მცდელობების მხარდაჭერა, რომელიც დაეხმარება საზოგადოების უდიდეს გამოწვევებს, როგორიცაა კლიმატის ცვლილების შერბილება და ადაპტაცია, კიბოს ადრეული გამოვლენა და პრევენცია და კიბერ საფრთხეებთან ბრძოლა.

პარტნიორობა ასევე ღიაა ორგანიზაციებთან თანამშრომლობისთვის

თუ თქვენ ხართ ორგანიზაცია, რომელიც ავითარებს სასაზღვრო მოდელის AI-ს, შეგიძლიათ წარადგინოთ შეუერთდეთ და ითანამშრომლოთ Frontier Model Forum-თან.

ექსპერტის რჩევა:

სპონსორირებული

კომპიუტერის ზოგიერთი პრობლემის მოგვარება რთულია, განსაკუთრებით მაშინ, როდესაც საქმე ეხება დაკარგული ან დაზიანებული სისტემის ფაილებსა და Windows-ის საცავებს.

დარწმუნდით, რომ გამოიყენეთ სპეციალური ინსტრუმენტი, როგორიცაა ფორტექტი, რომელიც დაასკანირებს და ჩაანაცვლებს თქვენს გატეხილ ფაილებს მათი ახალი ვერსიებით მისი საცავიდან.

ფორუმის მიხედვით, სასაზღვრო მოდელი AI არის ფართომასშტაბიანი მანქანათმცოდნეობის მოდელი, რომელიც აღემატება იმ შესაძლებლობებს, რომლებიც ამჟამად არსებულ ყველაზე მოწინავე არსებულ მოდელებშია. და მას ასევე უნდა შეეძლოს მრავალფეროვანი დავალებების შესრულება.

პარტნიორობაში გასაწევრიანებლად, თქვენ, როგორც ორგანიზაცია, უნდა აკმაყოფილებდეთ შემდეგ კრიტერიუმებს:

- თქვენ უკვე ავითარებთ და განათავსებთ სასაზღვრო მოდელებს (როგორც განსაზღვრულია ფორუმის მიერ).

- ორგანიზაციას შეუძლია აჩვენოს ძლიერი ერთგულება სასაზღვრო მოდელის უსაფრთხოების მიმართ, მათ შორის ტექნიკური და ინსტიტუციური მიდგომებით.

- თქვენ, როგორც ორგანიზაციას, მზად ხართ წვლილი შეიტანოთ ფორუმის ძალისხმევის წინსვლაში, მათ შორის ერთობლივ ინიციატივებში მონაწილეობით და ინიციატივის განვითარებისა და ფუნქციონირების მხარდაჭერით.

ეს არის ის, რასაც ფორუმი გააკეთებს, როდესაც საქმე AI-ს ეხება

Frontier Model Forum-ს სურს ხელი შეუწყოს უსაფრთხო და პასუხისმგებელი ხელოვნური ინტელექტის განვითარების პროცესს და ის ფოკუსირებული იქნება 3 ძირითად სფეროზე 2023 წლის განმავლობაში:

- საუკეთესო პრაქტიკის იდენტიფიცირება: ხელი შეუწყოს ცოდნის გაზიარებას და საუკეთესო პრაქტიკას უსაფრთხოების სტანდარტებზე და უსაფრთხოების პრაქტიკაზე ფოკუსირებით პოტენციური რისკების ფართო სპექტრის შესამცირებლად.

- AI უსაფრთხოების კვლევის წინსვლა: მხარი დაუჭირეთ AI უსაფრთხოების ეკოსისტემას ხელოვნური ინტელექტის უსაფრთხოების შესახებ ყველაზე მნიშვნელოვანი ღია კვლევის კითხვების იდენტიფიცირებით. ფორუმი კოორდინაციას გაუწევს კვლევას ამ ძალისხმევის წინსვლისთვის ისეთ სფეროებში, როგორიცაა მოწინააღმდეგეების გამძლეობა, მექანიკური ინტერპრეტაცია, მასშტაბური ზედამხედველობა, დამოუკიდებელი კვლევის ხელმისაწვდომობა, გადაუდებელი ქცევები და ანომალია გამოვლენა. თავდაპირველად დიდი ყურადღება გამახვილდება ტექნიკური შეფასებებისა და სასაზღვრო AI მოდელების საჯარო ბიბლიოთეკის შემუშავებაზე და გაზიარებაზე.

- კომპანიებსა და მთავრობებს შორის ინფორმაციის გაზიარების ხელშეწყობა: ჩამოაყალიბეთ სანდო, უსაფრთხო მექანიზმები კომპანიებს, მთავრობებსა და შესაბამის დაინტერესებულ მხარეებს შორის ინფორმაციის გაზიარებისთვის ხელოვნური ინტელექტის უსაფრთხოებისა და რისკების შესახებ. ფორუმი მიჰყვება საუკეთესო პრაქტიკას პასუხისმგებელი გამჟღავნების სფეროში, როგორიცაა კიბერუსაფრთხოება.

2023 წლის განმავლობაში Frontier Model-ის ფორუმი იმუშავებს დაფის აწყობაზე, შემდეგ შეიმუშავებს სტრატეგიას და დაადგენს პრიორიტეტებს. მაგრამ ორგანიზაცია უკვე ცდილობს ითანამშრომლოს რაც შეიძლება მეტ ინსტიტუტთან, კერძო თუ საჯარო. ეს ასევე მოიცავს სამოქალაქო საზოგადოებებს და მთავრობებს, ისევე როგორც სხვა ინსტიტუტებს, რომლებიც დაინტერესებულნი არიან AI-ით.

რას ფიქრობთ ამ ახალ პარტნიორობაზე? გაინტერესებთ შემოერთება? ან გაინტერესებთ სასაზღვრო AI მოდელები? შეგვატყობინეთ ქვემოთ მოცემულ კომენტარების განყოფილებაში.