שותפות הבינה המלאכותית החדשה מבטיחה דרכים בטוחות יותר לפיתוח בינה מלאכותית.

- השותפות תרכיב מועצת יועצים ותתכנן אסטרטגיה בחודשים הבאים.

- הוא יתמקד אך ורק בדגמי AI גבוליים, המוגדרים כעדיפים על הקיימים.

- אם אתה ארגון שמפתח מודלים כאלה של AI, אתה יכול להצטרף לשותפות.

לפני שבוע, מיקרוסופט הכריזה על Lama 2, שותפות הבינה המלאכותית שלה עם Meta, ב-Microsoft Inspire 2023. Lama 2 הוא מודל שפה גדול בקוד פתוח, שבו אתה יכול להשתמש כדי לבנות ולאמן AI משלך. לפי השמועות, ה-LLM הזה הוא גם הרמז הראשון להשגת AGI, שהיא, בסופו של דבר, אחת המטרות המרכזיות של AI.

ובכן, תוך שבוע מההודעה, הרבה קרה. יש גם שמועות ש-OpenAI, החברה שמאחורי ChatGPT, משחררת LLM בקוד פתוח משלה, בשם הקוד G3PO. עדיין אין תאריך יציאה שלו, אבל זה יקרה ב-2023 או ב-2024.

ובתפנית של אירועים, נראה שמיקרוסופט שיתפה פעולה עם Anthropic, Google ו-Open AI לפורום Frontier Model. השותפות היא גוף תעשייתי המתמקד בהבטחת פיתוח בטוח ואחראי של דגמי AI גבוליים, לפי ההודעה לעיתונות.

היום, אנתרופיק, גוגל, מיקרוסופט ו-OpenAI מכריזות על הקמת פורום Frontier Model Forum, גוף תעשייתי חדש המתמקד בהבטחת פיתוח בטוח ואחראי של מודלים של בינה מלאכותית. פורום Frontier Model יתבסס על המומחיות הטכנית והתפעולית של החברות החברות בו כדי להועיל לכל האקולוגי של AI, כגון באמצעות קידום הערכות טכניות ואמות מידה, ופיתוח ספרייה ציבורית של פתרונות לתמיכה בשיטות עבודה מומלצות בתעשייה תקנים.

פורום מודל חזית

ביסודו של דבר, פורום Frontier Models רוצה לבנות AIs שאינם מהווים סיכון לבני אדם. אם אתה זוכר, אחד השותפים, אנתרופיק, בדיוק השתחרר קלוד 2 AI, והדגם ידוע בדרך שבה הוא מקיים אינטראקציה בטוחה עם אנשים. אז, יהיו לנו הרבה AI דומים לקלוד 2 AI, וכנראה אפילו טובים יותר. כך או כך, אלו חדשות מצוינות כשמדובר בתעשייה הזו.

מה יעשה פורום Frontier Models כשזה מגיע לבינה מלאכותית

השותפות קבעה מערך של יעדי ליבה ויעדים, והיא תפעל לפיהם. הם:

- קידום מחקר בטיחות בינה מלאכותית לקדם פיתוח אחראי של מודלים חזיתיים, למזער סיכונים ולאפשר הערכות עצמאיות וסטנדרטיות של יכולות ובטיחות.

- זיהוי שיטות עבודה מומלצות לפיתוח אחראי ופריסה של מודלים חזיתיים, המסייעים לציבור להבין את טבעה, היכולות, המגבלות וההשפעה של הטכנולוגיה.

- שיתוף פעולה עם קובעי מדיניות, אנשי אקדמיה, חברה אזרחית וחברות לחלוק ידע על אמון וסיכוני בטיחות.

- תמיכה במאמצים לפתח יישומים שיכולים לעזור לעמוד באתגרים הגדולים ביותר של החברה, כגון הפחתה והסתגלות לשינויי אקלים, גילוי מוקדם של סרטן ומניעה, ומאבק באיומי סייבר.

השותפות פתוחה גם לשיתוף פעולה עם ארגונים

אם אתה ארגון שמפתח בינה מלאכותית של מודל חזיתי, אתה יכול להגיש להצטרף ולשתף פעולה עם פורום Frontier Model.

טיפ מומחה:

ממומן

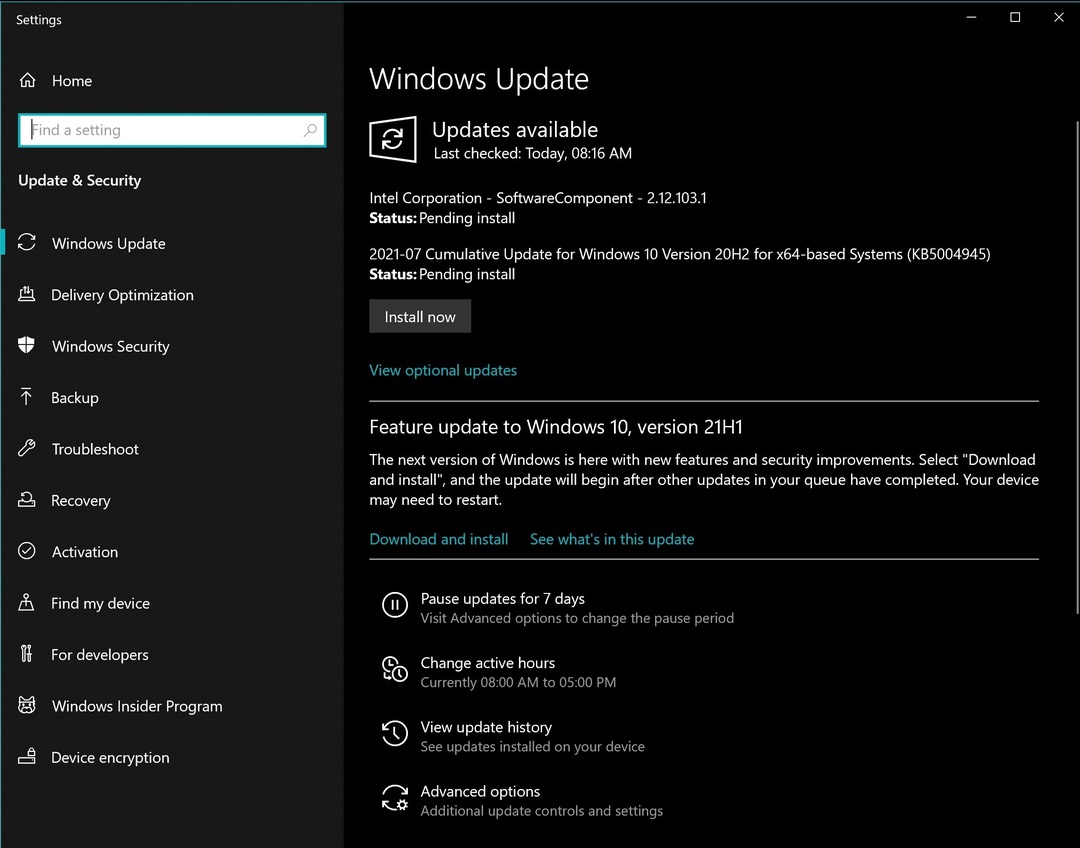

קשה להתמודד עם כמה בעיות במחשב, במיוחד כשמדובר בקבצי מערכת ומאגרים חסרים או פגומים של Windows שלך.

הקפידו להשתמש בכלי ייעודי, כגון Fortect, אשר יסרוק ויחליף את הקבצים השבורים שלך בגרסאות הטריות שלהם מהמאגר שלו.

על פי הפורום, דגם חזיתי בינה מלאכותית הוא מודל למידת מכונה בקנה מידה גדול העולה על היכולות הקיימות כיום בדגמים הקיימים המתקדמים ביותר. והוא גם אמור להיות מסוגל לבצע מגוון רחב של משימות.

כדי להצטרף לשותפות, אתה, כארגון, צריך לעמוד בקריטריונים הבאים:

- אתה כבר מפתח ופורס מודלים חזיתיים (כפי שהוגדרו על ידי הפורום).

- הארגון מסוגל להפגין מחויבות חזקה לבטיחות מודל חזיתית, כולל באמצעות גישות טכניות ומוסדיות.

- אתה, כארגון, מוכן לתרום לקידום מאמצי הפורום לרבות על ידי השתתפות ביוזמות משותפות ותמיכה בפיתוח ובתפקוד היוזמה.

זה מה שהפורום יעשה כשזה מגיע לבינה מלאכותית

פורום Frontier Model רוצה לתמוך בתהליך פיתוח AI בטוח ואחראי, והוא יתמקד בשלושה תחומים מרכזיים במהלך 2023:

- זיהוי שיטות עבודה מומלצות: קדם שיתוף ידע ושיטות עבודה מומלצות תוך התמקדות בתקני בטיחות ובנוהלי בטיחות כדי להפחית מגוון רחב של סיכונים פוטנציאליים.

- קידום מחקר בטיחות בינה מלאכותית: תמכו באקו-סיסטם הבטיחות של AI על ידי זיהוי שאלות המחקר הפתוחות החשובות ביותר בנושא בטיחות AI. הפורום יתאם מחקר כדי לקדם מאמצים אלה בתחומים כמו חוסן יריב, פרשנות מכניסטית, פיקוח ניתן להרחבה, גישה עצמאית למחקר, התנהגויות מתעוררות ואנומליה איתור. תחילה תהיה התמקדות חזקה בפיתוח ושיתוף של ספרייה ציבורית של הערכות טכניות ואמות מידה עבור דגמי AI גבוליים.

- הקלת שיתוף מידע בין חברות וממשלות: צור מנגנונים אמינים ומאובטחים לשיתוף מידע בין חברות, ממשלות ובעלי עניין רלוונטיים בנוגע לבטיחות וסיכונים של AI. הפורום יעקוב אחר שיטות עבודה מומלצות בחשיפה אחראית מתחומים כמו אבטחת סייבר.

במהלך שנת 2023, פורום Frontier Model יעבוד על הרכבת לוח, ולאחר מכן יבנה אסטרטגיה ויקבע סדרי עדיפויות. אבל הארגון כבר מחפש לשתף פעולה עם כמה שיותר מוסדות, פרטיים או ציבוריים. זה כולל גם חברות אזרחיות וממשלות, כמו גם מוסדות אחרים שמתעניינים בבינה מלאכותית.

מה אתה חושב על השותפות החדשה הזו? האם אתה מעוניין להצטרף? או האם אתה סקרן לגבי דגמי AI גבוליים? ספר לנו בקטע ההערות למטה.