InstructDiffusion es capaz de comprender significados semánticos y los utilizará para editar sus imágenes.

- InstructDiffusion es una IA capaz de utilizar instrucciones pasadas para adquirir la capacidad de comprender significados semánticos.

- El modelo también es capaz de tener impresionantes capacidades de generalización.

- Una vez que aprende acerca de una señal visual, el modelo la ampliará enormemente para entrenarse aún más.

El último modelo de IA de Microsoft, Difusión de instrucciones, transformará radicalmente tus imágenes, o cualquier imagen que puedas subir, según tus instrucciones. El modelo, desarrollado por Microsoft Research Asia, es una interfaz que reúne inteligencia artificial e instrucciones humanas para generar y completar una variedad de tareas visuales.

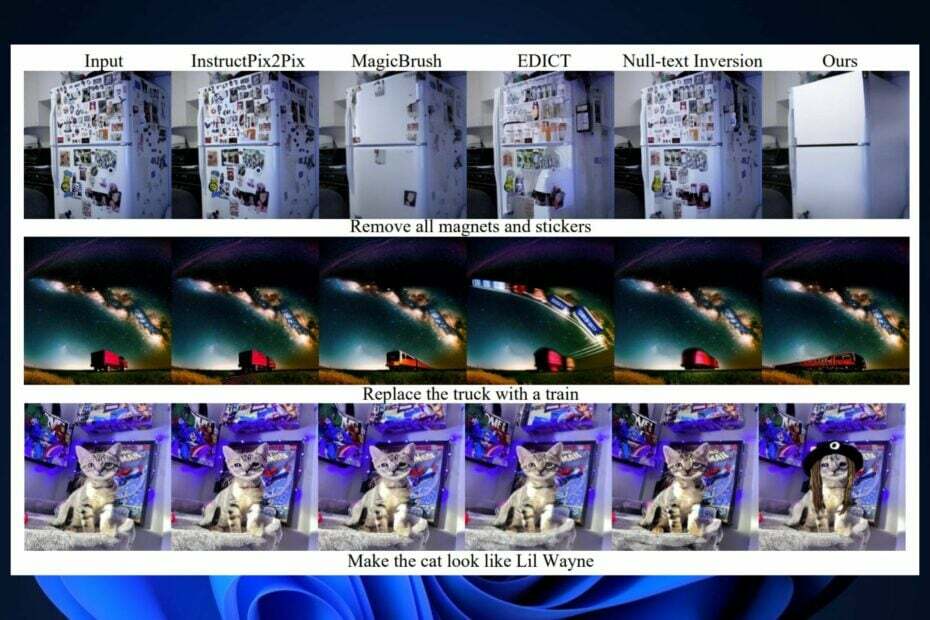

En otras palabras, usted elige una imagen que desea editar, cambiar o transformar, e InstructDiffusion implementará su visión por computadora para cambiar la imagen según su entrada.

Microsoft lanzado el papel para el modelo hace unos días, e InstructDiffusion ya tiene un

patio de juegos de demostración, donde podrás probar el modelo tú mismo.La innovación clave en IntructDiffusion es que el modelo no necesita conocimiento previo de la imagen, sino que utiliza un proceso de difusión para manipular píxeles. El modelo es capaz de realizar muchas funciones útiles, como segmentación, detección de puntos clave y restauración. En la práctica, InstructDiffusion utilizará sus instrucciones para cambiar la imagen.

En un ejemplo, Microsoft Research Asia pudo eliminar la marca de agua de una foto, simplemente indicando al modelo que lo hiciera.

InstructDiffusion de Microsoft es capaz de distinguir el significado detrás de sus instrucciones

InstructDiffusion, como muchos otros Modelos de IA de Microsoft, es capaz de tener un comportamiento innovador a la hora de resolver tareas. Microsoft Research Asia afirma que InstructDiffusion implementa tareas de comprensión y tareas generativas.

El modelo utilizará tareas de comprensión, como segmentación y detecciones de puntos clave, para ubicar el área y los píxeles que desea editar.

Por ejemplo, el modelo utiliza segmentación para localizar con éxito el área de su siguiente instrucción: pinte de rojo al hombre a la derecha de la imagen. Para detecciones de puntos clave, una instrucción sería: use amarillo para rodear la rodilla del hombre en el extremo izquierdo de la imagen.

Las tareas generativas se componen de tareas de edición y de restauración. InstructDiffusion no solo editará su imagen, sino que el modelo también generará nuevos elementos para la imagen, según sus instrucciones.

La característica más prometedora de Microsoft InstructDiffusion es su capacidad para generalizar con éxito todas las instrucciones que recibe para formar una comprensión profunda y coherente del significado detrás de ellas. En otras palabras, el modelo recordará las instrucciones que le diste y las utilizará con éxito para entrenarse aún más.

Pero el modelo también aprenderá a distinguir los significados detrás de sus instrucciones, lo que lo llevará a resolver tareas invisibles y a encontrar nuevas formas de generar elementos. Esta capacidad de comprender significados semánticos sitúa a InstructDifussion un paso más allá que otros modelos similares: los supera.

Sin embargo, InstructDiffusion también va un paso más allá para alcanzar AGI: Al comprender profundamente el significado semántico detrás de cada instrucción y ser capaz de generalizar con éxito visiones por computadora, el modelo avanzará enormemente en el desarrollo de la IA.

Microsoft Research Asia le permite probarlo en un patio de juegos de demostración, pero también puedes usa su código para entrenar tu propio modelo de IA.

¿Cuáles son vuestras opiniones sobre este modelo? ¿Lo intentarás?