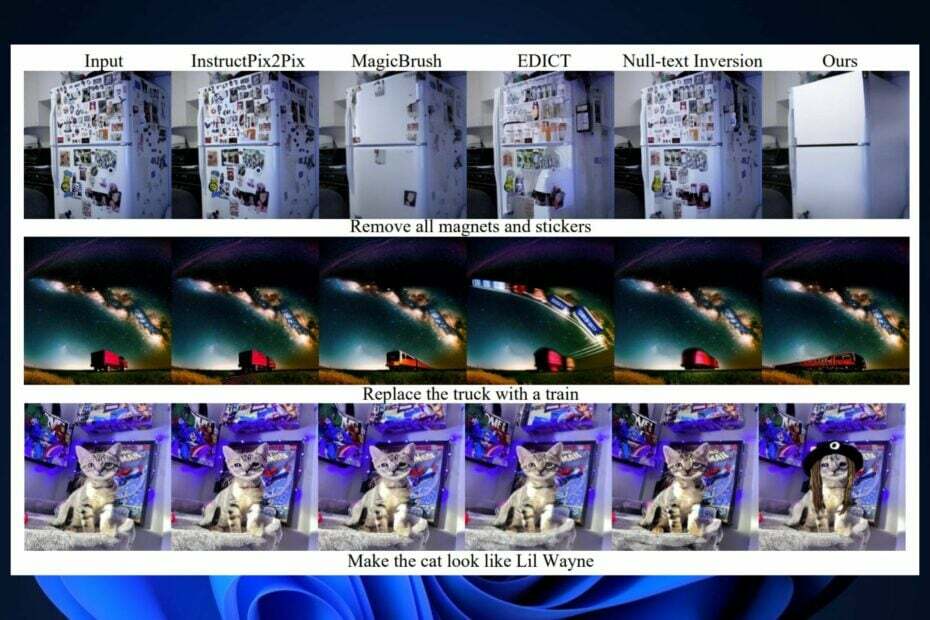

InstructDiffusion ist in der Lage, semantische Bedeutungen zu verstehen und diese zur Bearbeitung Ihrer Bilder zu verwenden.

- InstructDiffusion ist eine KI, die frühere Anweisungen nutzen kann, um semantische Bedeutungen zu verstehen.

- Das Modell verfügt außerdem über beeindruckende Generalisierungsfähigkeiten.

- Sobald es von einem visuellen Hinweis erfährt, wird das Modell diesen stark erweitern, um sich selbst noch weiter zu trainieren.

Das neueste KI-Modell von Microsoft, Verbreitung anweisen, wird Ihre Bilder oder jedes Bild, das Sie hochladen können, gemäß Ihren Anweisungen radikal verändern. Das von Microsoft Research Asia entwickelte Modell ist eine Schnittstelle, die KI und menschliche Anweisungen zusammenbringt, um eine Vielzahl visueller Aufgaben zu generieren und auszuführen.

Mit anderen Worten: Sie wählen ein Bild aus, das Sie bearbeiten, ändern oder umwandeln möchten, und InstructDiffusion veranlasst seine Computervision, das Bild basierend auf Ihrer Eingabe zu ändern.

Microsoft veröffentlicht

das Papier für das Modell vor ein paar Tagen, und InstructDiffusion hat bereits eine Demo-Spielplatz, wo Sie das Modell selbst ausprobieren können.Die wichtigste Neuerung bei IntructDiffusion besteht darin, dass das Modell keine Vorkenntnisse über das Bild benötigt, sondern stattdessen einen Diffusionsprozess zur Manipulation von Pixeln verwendet. Das Modell verfügt über viele nützliche Funktionen wie Segmentierung, Schlüsselpunkterkennung und Wiederherstellung. In der Praxis verwendet InstructDiffusion Ihre Anweisungen, um das Bild zu ändern.

In einem Beispiel konnte Microsoft Research Asia das Wasserzeichen auf einem Foto entfernen, indem es das Modell einfach dazu anwies.

InstructDiffusion von Microsoft ist in der Lage, die Bedeutung Ihrer Anweisungen zu erkennen

InstructDiffusion, wie viele andere auch Microsoft-KI-Modelle, ist zu innovativem Verhalten bei der Lösung von Aufgaben fähig. Microsoft Research Asia behauptet, dass InstructDiffusion Verständnisaufgaben und generative Aufgaben umsetzt.

Das Modell verwendet Verständnisaufgaben wie Segmentierung und Schlüsselpunkterkennung, um den Bereich und die Pixel zu lokalisieren, die bearbeitet werden sollen.

Beispielsweise verwendet das Modell die Segmentierung, um den Bereich Ihrer folgenden Anweisung erfolgreich zu lokalisieren: Malen Sie den Mann rechts im Bild rot. Für Schlüsselpunkterkennungen wäre eine Anweisung: Verwenden Sie Gelb, um das Knie des Mannes ganz links im Bild einzukreisen.

Die generativen Aufgaben setzen sich aus Bearbeitungs- und Wiederherstellungsaufgaben zusammen. InstructDiffusion bearbeitet nicht nur Ihr Bild, sondern das Modell generiert basierend auf Ihren Anweisungen auch neue Elemente für das Bild.

Das vielversprechendste Feature von Microsoft InstructDiffusion ist seine Fähigkeit, alle empfangenen Anweisungen erfolgreich zu verallgemeinern, um ein zusammenhängendes und tiefes Verständnis der Bedeutung dahinter zu entwickeln. Mit anderen Worten: Das Modell merkt sich die Anweisungen, die Sie ihm gegeben haben, und wird sie erfolgreich nutzen, um sich noch weiter zu trainieren.

Aber das Modell lernt auch, die Bedeutungen hinter Ihren Anweisungen zu unterscheiden, was es dazu bringt, bisher unbekannte Aufgaben zu lösen und neue Wege zur Generierung von Elementen zu finden. Mit dieser Fähigkeit, semantische Bedeutungen zu verstehen, ist InstructDifussion den anderen ähnlichen Modellen einen Schritt voraus: Es übertrifft sie.

Allerdings geht InstructDiffusion auch noch einen Schritt weiter um AGI zu erreichen: Durch ein tiefes Verständnis der semantischen Bedeutung jeder Anweisung und die Fähigkeit, Computervisionen erfolgreich zu verallgemeinern, wird das Modell die KI-Entwicklung erheblich vorantreiben.

Mit Microsoft Research Asia können Sie es in einem ausprobieren Demo-Spielplatz, aber du kannst auch Verwenden Sie seinen Code um Ihr eigenes KI-Modell zu trainieren.

Was ist eure Meinung zu diesem Modell? Wirst du es versuchen?