Det nyeste AI-partnerskab lover sikrere måder at udvikle AI på.

- Partnerskabet vil samle et råd af rådgivere og planlægge en strategi i de følgende måneder.

- Det vil udelukkende fokusere på frontier AI-modeller, som er defineret som værende overlegne i forhold til de eksisterende.

- Hvis du er en organisation, der udvikler sådanne AI-modeller, kan du deltage i partnerskabet.

For en uge siden, Microsoft annoncerede Llama 2, dets AI-partnerskab med Meta, på Microsoft Inspire 2023. Llama 2 er en stor open source-sprogmodel, som du kan bruge til at bygge og træne din egen AI. Dette LLM rygtes også at være det første spor til at opnå AGI, som i sidste ende er et af AI's centrale mål.

Nå, på en uge efter offentliggørelsen er der sket meget. Der er også rygter om, at OpenAI, firmaet bag ChatGPT, udgiver sin egen open source LLM, kodenavnet G3PO. Der er ikke nogen udgivelsesdato for det endnu, men det kommer til at ske i 2023 eller i 2024.

Og i en række begivenheder ser det ud til, at Microsoft har indgået partnerskab med Anthropic, Google og Open AI til Frontier Model Forum. Partnerskabet er et industriorgan, der fokuserer på at sikre sikker og ansvarlig udvikling af frontier AI-modeller,

ifølge pressemeddelelsen.I dag annoncerer Anthropic, Google, Microsoft og OpenAI dannelsen af Frontier Model Forum, et nyt industriorgan med fokus på at sikre sikker og ansvarlig udvikling af frontier AI-modeller. Frontier Model Forum vil trække på den tekniske og operationelle ekspertise fra sine medlemsvirksomheder til gavn for hele AI-økosystemet, som f.eks. gennem at fremme tekniske evalueringer og benchmarks og udvikle et offentligt bibliotek af løsninger til at understøtte industriens bedste praksis og standarder.

Frontier Model Forum

Grundlæggende ønsker Frontier Model Forum at bygge AI'er, der ikke er en risiko for mennesker. Hvis du husker det, er en af partnerne, Anthropic, netop løsladt Claude 2 AI, og modellen er kendt for den måde, den sikkert interagerer med mennesker på. Så vi kommer til at have mange AI'er, der ligner Claude 2 AI, og sandsynligvis endnu bedre. Uanset hvad, er det fremragende nyheder, når det kommer til denne branche.

Hvad vil Frontier Model Forum gøre, når det kommer til AI

Partnerskabet har etableret et sæt kernemål og målsætninger, og det vil arbejde i overensstemmelse med dem. De er:

- Fremme forskning i AI-sikkerhed at fremme ansvarlig udvikling af grænsemodeller, minimere risici og muliggøre uafhængige, standardiserede evalueringer af kapaciteter og sikkerhed.

- Identifikation af bedste praksis til ansvarlig udvikling og implementering af grænsemodeller, der hjælper offentligheden med at forstå teknologiens natur, muligheder, begrænsninger og virkninger.

- Samarbejde med politiske beslutningstagere, akademikere, civilsamfundet og virksomheder at dele viden om tillid og sikkerhedsrisici.

- Støtte til bestræbelserne på at udvikle applikationer, der kan bidrage til at møde samfundets største udfordringer, såsom afbødning og tilpasning af klimaændringer, tidlig opdagelse og forebyggelse af kræft og bekæmpelse af cybertrusler.

Partnerskabet er også åbent for samarbejde med organisationer

Hvis du er en organisation, der udvikler frontier model AI, kan du melde dig til og samarbejde med Frontier Model Forum.

Ekspert tip:

SPONSORERET

Nogle pc-problemer er svære at tackle, især når det kommer til manglende eller beskadigede systemfiler og arkiver i din Windows.

Sørg for at bruge et dedikeret værktøj, som f.eks Fortect, som vil scanne og erstatte dine ødelagte filer med deres friske versioner fra dets lager.

Ifølge Forum er en frontier model AI en storstilet maskinlæringsmodel, der overgår de muligheder, der i øjeblikket findes i de mest avancerede eksisterende modeller. Og den skal også kunne udføre en bred vifte af opgaver.

For at deltage i partnerskabet skal du som organisation opfylde følgende kriterier:

- Du udvikler og implementerer allerede grænsemodeller (som defineret af forummet).

- Organisationen er i stand til at demonstrere et stærkt engagement i grænseoverskridende modelsikkerhed, herunder gennem tekniske og institutionelle tilgange.

- Du som organisation er villig til at bidrage til at fremme Forummets indsats, herunder ved at deltage i fælles initiativer og understøtte initiativets udvikling og funktion.

Det er, hvad forummet vil gøre, når det kommer til kunstig intelligens

Frontier Model Forum ønsker at understøtte en sikker og ansvarlig AI-udviklingsproces, og det vil fokusere på 3 nøgleområder i løbet af 2023:

- Identifikation af bedste praksis: Fremme videndeling og bedste praksis med fokus på sikkerhedsstandarder og sikkerhedspraksis for at mindske en lang række potentielle risici.

- Fremme AI-sikkerhedsforskning: Støt AI-sikkerhedsøkosystemet ved at identificere de vigtigste åbne forskningsspørgsmål om AI-sikkerhed. Forummet vil koordinere forskning for at fremme disse bestræbelser på områder som modstandsdygtighed, mekanistisk fortolkning, skalerbart tilsyn, uafhængig forskningsadgang, emergent adfærd og anomali opdagelse. Der vil i første omgang være et stærkt fokus på at udvikle og dele et offentligt bibliotek af tekniske evalueringer og benchmarks for frontier AI-modeller.

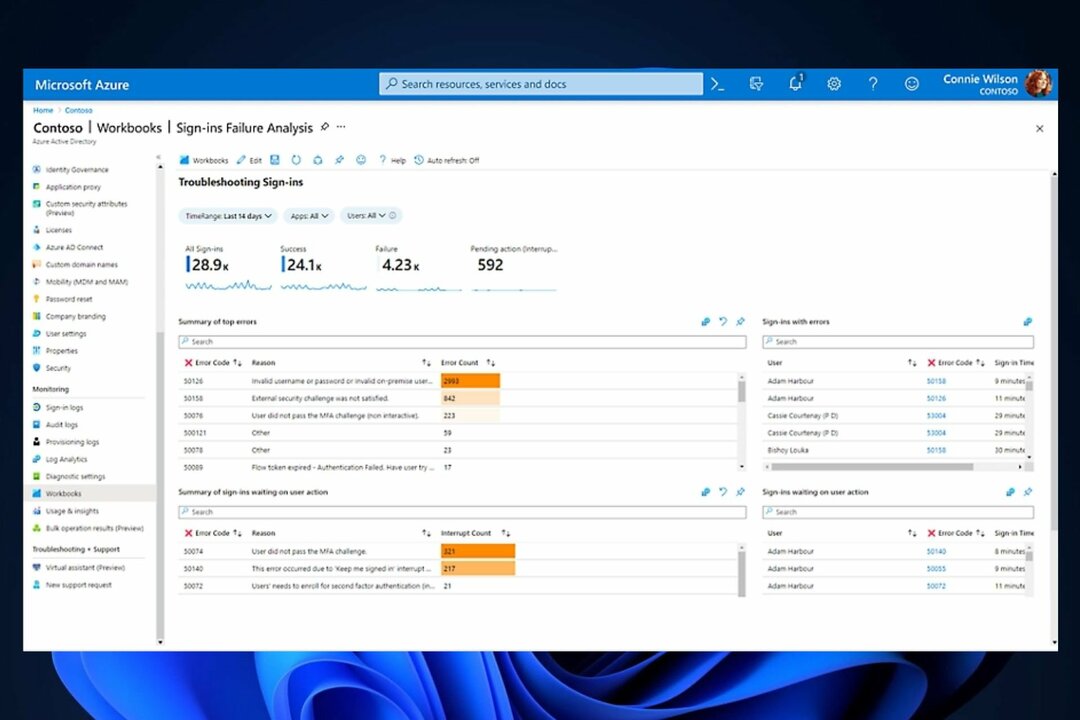

- Facilitering af informationsdeling mellem virksomheder og regeringer: Etabler pålidelige, sikre mekanismer til deling af information mellem virksomheder, regeringer og relevante interessenter vedrørende AI-sikkerhed og -risici. Forummet vil følge bedste praksis inden for ansvarlig offentliggørelse fra områder som cybersikkerhed.

I løbet af 2023 vil Frontier Model-forummet arbejde på at sammensætte en bestyrelse, derefter bygge en strategi og fastlægge prioriteter. Men organisationen søger allerede nu at samarbejde med så mange institutioner som muligt, private eller offentlige. Dette omfatter også civilsamfund og regeringer samt andre institutioner, der er interesseret i kunstig intelligens.

Hvad synes du om dette nye partnerskab? Er du interesseret i at være med? Eller er du nysgerrig efter frontier AI-modeller? Fortæl os det i kommentarfeltet nedenfor.