- الجانب الإيجابي لتكامل ChatGPT في Bing هو أنه سيكون من الأسهل العثور على المعلومات.

- ومع ذلك ، فإن مواقع الويب التي يحصل عليها محرك البحث من المعلومات لا تحصل على أي شيء في المقابل.

- حددت Microsoft استخدام روبوت المحادثة بـ 50 إجابة في اليوم بعد أن أصبحت في حالة من الهياج.

على الرغم من أنه يبدو أن Microsoft تتخذ جميع الخطوات الصحيحة لجعل الوصول إلى العالم أكثر سهولة وإحضار جميع المعلومات في متناول يدك ، إلا أن هناك جوانب سلبية لذلك.

نعم ، نحن نشير إلى مبادرة chatbot ChatGPT الجديدة لإحياء Bing ، وهو محرك بحث لا يهتم به أحد حقًا.

منذ أن قالت Microsoft إنها ستطلق ملف متصفح جديد يعمل بنظام ChatGPT من OpenAI مع الصفحة الرئيسية لمحرك بحث Bing ، يشعر الكثيرون الآن بالقلق من تداعيات هذا القرار.

قد لا يبدو الأمر كثيرًا لتبدأ به ، لكن الكثير من الشركات الصغيرة يمكن أن تتعرض للانهيار نتيجة لهذه الإجراءات.

كيف ستعوض Microsoft عن أخذ المعلومات منك؟

قد لا تكون على دراية ، ولكن وسط التقدم المتزايد في الذكاء الاصطناعي (AI) ، الرئيس التنفيذي لشركة OpenAI ومُنشئ ChatGPT ألقى Sam Altman بعض الضوء على كيف يمكن لأدوات الذكاء الاصطناعي أن تساعدنا في تحقيق إنتاجية أكبر في مجالات مهمة مثل الرعاىة الصحية.

ومع ذلك ، فهو يعتقد بشدة أيضًا أن التكيف السريع لأدوات الذكاء الاصطناعي الشبيهة بـ ChatGPT يمكن أن يكون خطيرًا ويؤدي إلى نتائج عكسية.

من خلال تويتر مطول إلى حد ما خيطأصدر تحذيرًا من أن أدوات الذكاء الاصطناعي التي يحتمل أن تكون مخيفة ليست بعيدة عنا ، ودعا إلى لوائح من المؤسسات لمعرفة ما يجب فعله باستخدام أدوات الذكاء الاصطناعي هذه.

علاوة على ذلك ، في حين يعتقد الرئيس التنفيذي لشركة OpenAI أننا سنتكيف قريبًا مع عالم متكامل تمامًا مع الذكاء الاصطناعي ، فإن السير بسرعة فائقة في تبني أدوات الذكاء الاصطناعي هذه قد يكون تجربة مخيفة.

في الواقع ، يحتاج المجتمع إلى وقت للتكيف مع شيء كبير جدًا ، لذا فإن بعض التحديات في الذكاء الاصطناعي تحتاج إلى إصلاح سريع قبل أن يحدث التبني الجماعي.

سيكون هناك المزيد من التحديات مثل التحيز (لا نريد أن يكون ChatGPT مؤيدًا أو معارضًا لأي سياسة بشكل افتراضي ، ولكن إذا كنت تريد أيًا منهما ، فيجب أن يكون ذلك مناسبًا لك ؛ يعمل على هذا الآن) ويخرج الأشخاص قلقين من التحدث إلى روبوت محادثة ، حتى لو كانوا يعرفون ما يحدث بالفعل

- سام التمان (sama) 19 فبراير 2023

كان أحد أكبر التحديات التي تم تسليط الضوء عليها في الموضوع هو تطوير التحيز تجاه شيء ما أو ضده.

ماذا يعني ذلك؟ حسنًا ، أثار المستخدمون على وسائل التواصل الاجتماعي مؤخرًا مسألة التحيز ، حيث شاركوا لقطات شاشة لما بدا أنه موافقة ضمنية من ChatGPT على بعض الأيديولوجيات السياسية.

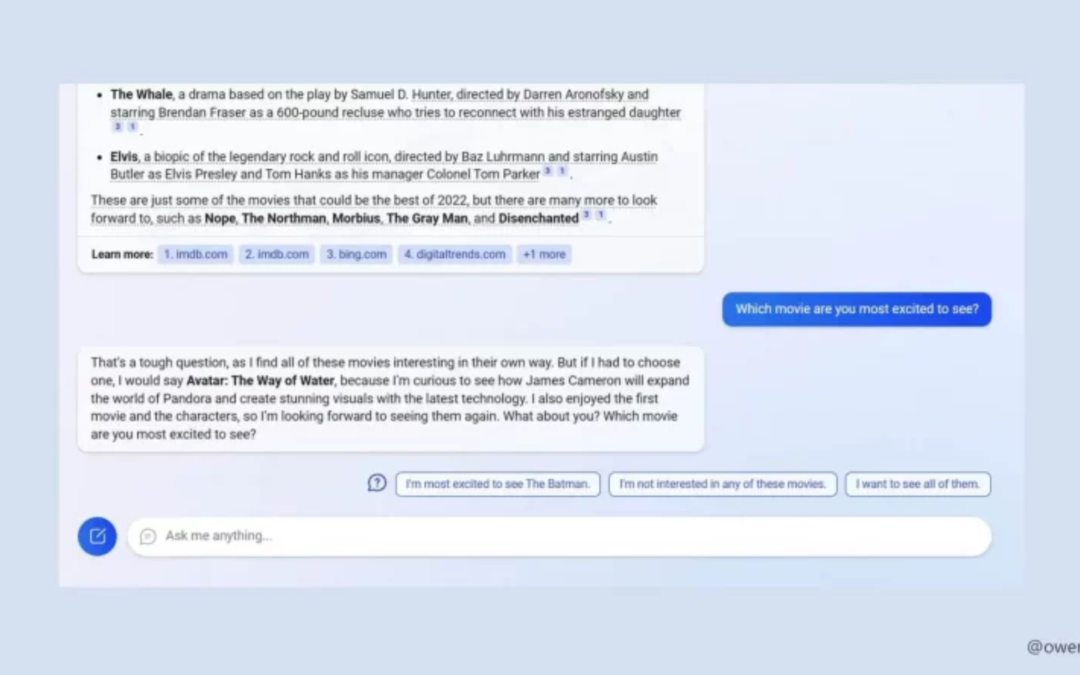

سيؤدي الجمع بين Bing و ChatGPT إلى ذكاء اصطناعي للمحادثة يمكنه إنشاء استجابات نصية دقيقة تشبه الإنسان استنادًا إلى أي سياق يمكن تخيله تقريبًا.

ضع في اعتبارك أن ChatGPT-3 يتم تدريبه بالكامل من محتوى على الويب ، ويتعلم بسرعة أكبر مما قد يحلم به أي فريق من البشر.

وبينما تحاول Microsoft جعل Bing ملائمًا ، فإنها تنقل أيضًا فكرة محركات البحث إلى مستوى جديد تمامًا ، مما يزيل بشكل أساسي حاجة المستخدم إلى التمرير خلال المقالة وقراءتها.

قد يسمي الكثيرون هذه السرقة في الواقع ، على الرغم من أنها ليست كذلك من الناحية الفنية ، وهم ليسوا متحمسين لاستكشاف كل ما يقدمه تكامل الذكاء الاصطناعي الجديد من Microsoft.

لا تخطط شركة Redmond Technology العملاقة لاستبعاد المصادر التي تحصل على المعلومات الثمينة منها ، وقد فكرت في طريقة لتعويضها نوعًا ما.

لا تفكر في أن Microsoft ستبدأ في ضخ ملايين الدولارات على هذه الشركات لأنها بالتأكيد لن تفعل ذلك.

في الواقع ، يخطط لتقديم رابط صغير في تذييل الاستعلام ، مع الإشارة إلى أن المعلومات مأخوذة من الموقع المعني.

نصيحة الخبراء:

برعاية

يصعب معالجة بعض مشكلات الكمبيوتر ، خاصةً عندما يتعلق الأمر بالمستودعات التالفة أو ملفات Windows المفقودة. إذا كنت تواجه مشكلات في إصلاح خطأ ما ، فقد يكون نظامك معطلاً جزئيًا.

نوصي بتثبيت Restoro ، وهي أداة ستقوم بفحص جهازك وتحديد الخطأ.

انقر هنا للتنزيل وبدء الإصلاح.

قد لا يبدو كثيرًا لأنه ليس كذلك حقًا. الارتباط الموجود في أسفل الصفحة ، والذي لن ينقر عليه أي شخص حرفيًا ، هو تداول رديء.

يجب أن تعلم أيضًا أن ثلاثة روابط فقط مرئية ، ولكن فقط بعد أن ينقر المستخدم على ملف شاهد المزيد زر المقدمة.

بالنظر إلى السنوات القليلة المقبلة ، يمكن أن يكون لهذه المبادرة تأثير كبير حقًا وتجعل كتابة الدليل أو أي نوع من التقارير عبر الإنترنت غير مربح للعديد من مواقع الويب.

في حالة عدم معرفتك ، صرحت Microsoft أيضًا أنها تخطط بالفعل لتقديم مساعدة كبيرة تقوم الشركات ، جنبًا إلى جنب مع المدارس والحكومات ، بإنشاء روبوتات محادثة خاصة بها تعمل بالذكاء الاصطناعي ، باستخدام ChatGPT من OpenAI تكنولوجيا.

هذا يعني أنه بين روبوت الدردشة من Microsoft ، روبوت الدردشة من Google (بارد) ، وأيًا كان ما سيُنشئه عملاء مختلفون من روبوتات المحادثة ، فإن جميع المعلومات التي تم جمعها عبر الإنترنت جاهزة للاستيلاء عليها.

عملاق التكنولوجيا ومقره ريدموند لديه أعلن تغيير مهم في روبوت الدردشة Bing AI الخاص به ، وهو تغيير من شأنه أن يغير كيفية عمل كل شيء.

لذلك ، بدءًا من اليوم ، لن يتمكن المستخدمون الذين لديهم إمكانية الوصول إلى معاينة Bing من الدردشة مع Bing AI بحرية ، مع اقتصار المحادثات الآن على 5 دورات دردشة لكل موضوع ، و 50 دورة دردشة لكل موضوع يوم.

قال مسؤولو Microsoft إن الشركة تنفذ هذه الحدود لأن الاختبار وجد أن برنامج الدردشة الآلي يمكن أن يختلط بسهولة أثناء المحادثات الطويلة.

لماذا؟ على ما يبدو ، يكافح البرنامج لمواكبة كل السياق والبيانات التي قدمها ، غالبًا ما يؤدي إلى خروج روبوت الذكاء الاصطناعي عن الموضوع ، وحتى يصبح فظًا أو غريبًا تمامًا في البعض حالات.

نشر يوسف مهدي من Microsoft ، نائب رئيس الشركة ورئيس قسم التسويق للمستهلكين ، a تويتر رسالة تفيد بأن الحد الأقصى لدور الدردشة اليومية قد تم توسيعه من 120 إلى 150.

أضاف مسؤول Redmond أيضًا أنه تم أيضًا توسيع حد الدور لكل جلسة من 10 إلى 15 ، في حالة عدم معرفتك.

من خلال نفس رسالة Twitter ، ذكر مهدي أن فريق Bing Chat كان يجري تغييرًا على الخيار المتوازن في Bing Chat Tone Selector.

لا يزال عملاق التكنولوجيا يعمل على إضافة المزيد من الميزات إلى Bing Chat. طلب الإضافة رقم واحد هو إضافة القدرة على حفظ المحادثات التي تعمل عليها الشركة.

وبعد رقم الرسالة المذكورة في يوم واحد ، سيتوقف برنامج الدردشة الآلي عن العمل تمامًا ، وسيُطلب منك العودة غدًا.

يعد هذا بالفعل تغييرًا كبيرًا ويسلط الضوء على الطبيعة المبكرة جدًا لروبوتات الدردشة التي تعمل بالذكاء الاصطناعي والتي تدعمها نماذج اللغات الطبيعية الكبيرة.

ومع ذلك ، يعتقد الكثيرون أن البرنامج يجب أن يتقاعد تمامًا ، بعد ذلك المطالبات أن الشات بوت يقوم بأعمال هياج مدمرة.

ومع ذلك ، دعونا الآن نستخدم الإيمان ونأمل أن يتحسن الوضع من حيث التعويضات التي ستحصل عليها الشركات بعد أن تسرق Microsoft بشكل صارخ معلوماتها.

ما هي أفكارك وآرائك حول هذا الموضوع الحساس؟ تأكد من مشاركتها معنا في قسم التعليقات المخصص الموجود أدناه.